Discover BIMPRAXIS

BIMPRAXIS

BIMPRAXIS

Author: Julio Pablo Vazquez

Subscribed: 0Played: 0Subscribe

Share

© Julio Pablo Vazquez Lopez

Description

Podcast oficial de BIMPRAXIS.

Hablamos de Inteligencia Artificial, Building Information Modeling, por separado o en virtuosa intersección (IA + BIM).

40 Episodes

Reverse

La integración de la inteligencia artificial (IA) en el mundo del Building Information Modeling (BIM) es un tema cada vez más relevante. En este contexto, se exploran dos enfoques opuestos para aprovechar la IA en Autodesk Revit: por un lado, el plugin BeamLogic Copilot, que ofrece una solución lista para usar y permite a los usuarios interactuar con su modelo de manera conversacional; por otro, el framework de código abierto Revit MCP, que proporciona una herramienta modular y personalizable para desarrolladores. Ambas opciones tienen sus ventajas y desventajas, y la elección entre ellas dependerá de las necesidades específicas de cada estudio o empresa.

Descubriendo el Futuro de la Ciencia: El Protocolo de Contexto Científico (SCP)

El avance científico se enfrenta a un desafío significativo: la integración de conocimientos y recursos dispersos. Para abordar esto, surge el Protocolo de Contexto Científico (SCP), una iniciativa que aspira a crear un estándar abierto y una red global de agentes científicos autónomos. Esto permitiría la colaboración fluida entre investigadores y recursos de todo el mundo, acelerando el descubrimiento y la innovación. Con una plataforma funcional ya en marcha y más de 1.600 recursos disponibles, el SCP abre un camino hacia una ciencia más escalable, multi-institucional y autónoma. Sin embargo, también plantea importantes preguntas éticas y políticas sobre la gobernanza y el uso responsable de esta tecnología.

Entendiendo el significado de las palabras con IA

La inteligencia artificial puede aprender a entender el significado de las palabras a través de modelos como Word2Vec, Glove y FastText, que utilizan vectores para representar las relaciones semánticas entre palabras. Estos modelos pueden aprender a partir de grandes cantidades de texto y capturar relaciones complejas, como la similitud entre palabras y la relación entre conceptos. Sin embargo, tienen limitaciones, como la creación de representaciones estáticas que no dependen del contexto. El modelo BERT, desarrollado por Google en 2018, revolucionó este campo al introducir un enfoque bidireccional que permite al modelo leer y entender el texto de manera más similar a como lo hace un humano.

🎹 ¿Sabías que el genio de Beethoven dependía de una tecnología que apenas acababa de inventarse? 🎼 Viajamos a la Viena de finales del siglo XVIII para descubrir cómo la revolución industrial del piano permitió una expresividad y un rango dinámico antes tecnológicamente imposibles. Exploramos cómo las mejoras en el hardware permitieron al artista romper con lo establecido y crear un nuevo tipo de arte, transformando para siempre la experiencia humana. ✨

🧠 Hoy, nuestros teclados controlan instrumentos mucho más extraños y potentes: la Inteligencia Artificial. ⚡️ Analizamos el ensayo Measure Up de Dean W. Ball para entender por qué los modelos de lenguaje son los pianos de nuestra era y cómo, al igual que Beethoven, debemos atrevernos a romper las cuerdas de estos nuevos simuladores cognitivos para descubrir su verdadero potencial y ver si realmente dan la talla. 🚀

Fuentes:

• Measure Up - Dean W. Ball

¿Alguna vez te has preguntado si la Inteligencia Artificial debería imitar nuestros defectos o corregirlos? 🤖 En este episodio exploramos el fascinante dilema entre “enmascarar o reflejar”, analizando un experimento masivo donde modelos como Gemini, GPT y Claude simularon una elección de líderes en un escenario de supervivencia 🌊. Descubre por qué algunas IAs actúan como un espejo fiel de los prejuicios humanos (incluyendo el sesgo de género), mientras que otras intentan ponerse una máscara de meritocracia para tomar decisiones más óptimas, aunque menos “humanas”. 🎭

Los hallazgos revelan una tensión crítica para el futuro de la tecnología social: mientras unos modelos replican nuestra tendencia a sobre-elegir líderes masculinos 👔, otros logran mejores resultados ignorando las señales sociales. Analizamos qué ocurre cuando ocultamos la identidad a la IA y por qué el contexto es la clave de todo. ¡Dale al play ▶️ para descubrir si queremos que la tecnología sea nuestro reflejo exacto o nuestra mejor versión posible! 🚀

Fuentes:

• To Mask or to Mirror: Human-AI Alignment in Collective Reasoning (ACL Anthology)

🚀 ¿El fin de la era de los chatbots genéricos? Mira Murati (ex-CTO de OpenAI) regresa a lo grande con Thinking Machines Lab tras levantar 2.000 millones de dólares. Pero no esperes otro clon de ChatGPT; su propuesta, Tinker, es una revolución técnica diseñada para devolverte el control absoluto. 🧠 En este episodio desglosamos qué es exactamente esta “cocina industrial” de IA que promete resolver el gran talón de Aquiles de los modelos actuales: la consistencia y el razonamiento fiable, permitiendo a los desarrolladores cocinar sus propios modelos sin preocuparse por la infraestructura pesada.

🛠️ Olvídate de los prompts mágicos; aquí venimos a hablar de ingeniería real. Analizamos cómo Tinker abstrae la complejidad de los clústeres de GPUs para que, con tu propio script de Python y tus datasets, puedas entrenar desde modelos multimodales que “ven” interfaces hasta agentes autónomos que aprenden por ensayo y error en entornos simulados. 🎓 Descubre si tienes lo necesario para pasar de usuario a arquitecto de IA y cómo esta herramienta permite crear modelos expertos capaces de interactuar con software de ingeniería o medicina. 🎧 ¡Dale al play para entender el futuro de la IA personalizada!

En este episodio, analizamos cómo un fanboy de Larry Page está utilizando el “dilema del innovador” en contra del gigante de las búsquedas: mientras Google teme canibalizar sus millonarios ingresos publicitarios, Perplexity ofrece respuestas directas, citadas y precisas. Descubre cómo esta startup actúa como un director de orquesta 🎻 de la inteligencia artificial, integrando múltiples modelos para priorizar la velocidad y la veracidad sin los costes imposibles de sus competidores.

De valer 520 millones a 14.000 millones de dólares en tiempo récord 🚀, Perplexity se ha convertido en el unicornio más codiciado del momento. Exploramos su crecimiento explosivo de usuarios, los rumores de alianzas estratégicas con Apple 🍏 o Samsung que podrían cambiar las reglas del juego en nuestros móviles, y qué significa realmente el concepto técnico de “perplejidad” en los modelos de lenguaje. Dale al play ▶️ para entender si estamos ante el fin de la hegemonía de los “10 enlaces azules” y quién ganará este nuevo Juego de Tronos de la IA. ⚔️

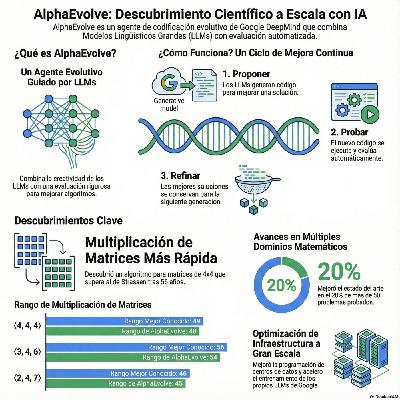

¿Te imaginas una IA que no solo escribe código, sino que evoluciona sus propios algoritmos para descubrir matemáticas nuevas? 🧬 En este episodio exploramos a fondo AlphaEvolve, el revolucionario agente de codificación de Google DeepMind que está redefiniendo los límites de la ciencia y la computación. A diferencia de los modelos de lenguaje tradicionales que pueden alucinar, este sistema utiliza un enfoque evolutivo para iterar, corregir y superoptimizar soluciones mediante la ejecución real de código. Desde mejorar la eficiencia de los centros de datos de Google ☁️ hasta rediseñar circuitos de hardware, analizamos cómo esta tecnología está cerrando la brecha entre la generación de ideas y el descubrimiento científico verificable. 🚀

Descubre cómo AlphaEvolve logró romper un estancamiento de 56 años al encontrar un algoritmo más rápido para la multiplicación de matrices complejas 4x4 y cómo ha resuelto problemas abiertos en combinatoria y geometría que desafiaban a los expertos. 🤯 Debatiremos sobre su capacidad para actuar como un colaborador de investigación, generando matemáticas constructivas a escala y encontrando soluciones que escapan a la intuición humana. Si te apasiona la intersección entre la Inteligencia Artificial, la ingeniería de software extrema y los grandes enigmas teóricos, este episodio es imprescindible. ¡Dale al play y acompáñanos a vislumbrar el futuro de la optimización algorítmica! 🎧⚡

Enlaces relevantes:

• Paper original: AlphaEvolve: A coding agent for scientific and algorithmic discovery

• Artículo en el blog de Google DeepMind sobre AlphaEvolve

• Paper complementario: Mathematical exploration and discovery at scale

¿Alguna vez te has preguntado cómo logramos que los gigantescos Modelos de Lenguaje Grande (LLMs) quepan en dispositivos más pequeños sin perder su “inteligencia”? 🧠✨ En este episodio desglosamos el fascinante mundo de la Knowledge Distillation (Destilación de Conocimiento), la técnica maestra que transfiere la sabiduría de un modelo “profesor” masivo a un “alumno” ágil y eficiente. 📱 Pero hay una trampa en los métodos actuales: descubriremos por qué los atajos populares, como guardar solo las probabilidades más altas (Top-K), están creando modelos sesgados y peligrosamente sobreconfiados en sus errores. 🚫🔍

Nos sumergimos en la última investigación de 2025, “Sparse Logit Sampling”, que propone una solución elegante y poderosa: la Random Sampling Knowledge Distillation. 📉💡 Analizamos cómo este nuevo enfoque utiliza el muestreo por importancia para lograr estimaciones imparciales almacenando apenas 12 tokens (frente a los miles habituales), reduciendo drásticamente el almacenamiento sin sacrificar la calidad del aprendizaje. 🚀 Dale al play para entender cómo esta técnica preserva la información crítica de la “cola” de probabilidades y está redefiniendo la eficiencia en la IA con un coste computacional mínimo. 🎧🔥

Enlaces relevantes:

• Paper original: Sparse Logit Sampling: Accelerating Knowledge Distillation in LLMs (ArXiv)

• Conceptos básicos: Destilación de Conocimiento (Wikipedia)

¿Y si te dijera que el futuro de la Inteligencia Artificial no está en hacer los modelos más grandes, sino más pequeños? 🤔 Mientras el mundo sigue maravillado con la capacidad de conversación humana de los LLMs masivos, una nueva investigación plantea que los Small Language Models (SLMs) son la verdadera clave para escalar la IA Agéntica. 🤖 En este episodio, desglosamos por qué utilizar modelos gigantes para tareas repetitivas es ineficiente y cómo los SLMs están demostrando ser suficientemente poderosos, mucho más adecuados y necesariamente más económicos para los sistemas autónomos que vienen.

Sumérgete con nosotros en el fascinante concepto de los sistemas agénticos heterogéneos, una arquitectura donde múltiples modelos colaboran y donde la especialización supera a la generalización. 💡 Hablaremos sobre la propuesta de convertir agentes basados en LLM a versiones SLM más ligeras y rápidas, reduciendo drásticamente los costes de despliegue sin sacrificar rendimiento. Si quieres entender por qué la agilidad y la eficiencia operativa están a punto de destronar al tamaño bruto en la industria de la IA, este análisis es para ti. ¡Dale al play y adelántate a la próxima gran tendencia tecnológica! 🚀📉

Fuentes mencionadas:

• Paper: Small Language Models are the Future of Agentic AI (arXiv)

¿Te imaginas una IA que piensa antes de responder? 🧠 En este episodio exploramos el lanzamiento de OpenAI o1, el nuevo modelo que rompe con lo establecido al utilizar una profunda cadena de pensamiento interna. A diferencia de sus predecesores, este sistema se toma su tiempo para razonar, identificar errores y descomponer problemas complejos paso a paso. Descubre cómo esta tecnología ha logrado superar a expertos humanos (PhD) en física, química y biología 🧪, y posicionarse entre los 500 mejores estudiantes de matemáticas de EE. UU. 🎓✨.

Analizamos qué significa realmente este salto cualitativo desde GPT-4o: desde su impresionante percentil 89 en programación competitiva 💻 hasta su capacidad para mejorar drásticamente la seguridad y alineación del modelo gracias a su razonamiento 🛡️. ¿Estamos ante el fin de la IA que solo “predice” palabras y el inicio de la IA que deduce? Dale al play ▶️ y acompáñanos a descifrar los secretos, la estrategia de “ocultar el pensamiento” y el inmenso potencial de aprender a razonar con los nuevos LLM. ¡No te lo pierdas! 🚀

Fuente: OpenAI: Aprender a razonar con los LLM

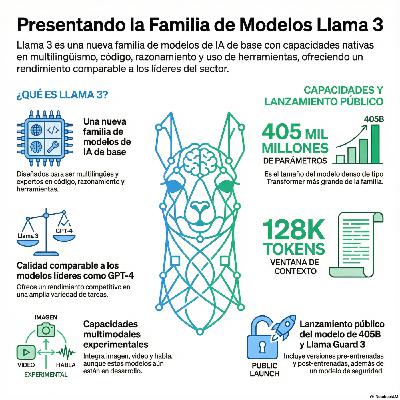

🦙 ¿Está Llama 3 a la altura de GPT-4? En este episodio desgranamos el paper “The Llama 3 Herd of Models”, donde se presenta la nueva familia de modelos fundacionales que está sacudiendo el panorama de la Inteligencia Artificial. Analizamos a la joya de la corona: un Transformer denso de 405.000 millones de parámetros con una impresionante ventana de contexto de 128K tokens. Descubre cómo este ““rebaño”” (herd) de modelos nativos domina tareas complejas de programación 💻, razonamiento lógico 🧠 y multilingüismo 🌍, ofreciendo una calidad comparable a los sistemas cerrados líderes del mercado.

🔬 Pero la evolución va más allá del texto. Exploramos el enfoque composicional de Llama 3 para integrar capacidades multimodales de imagen, video 📹 y voz 🗣️, las cuales ya muestran un rendimiento competitivo frente al estado del arte. Además, discutimos la implementación de Llama Guard 3, el guardián diseñado para garantizar la seguridad tanto en las entradas como en las salidas del modelo. Si quieres entender la arquitectura detrás de esta revolución y qué significa para el futuro de la IA, ¡dale al play y acompáñanos en este análisis técnico! 🎧✨

Fuentes:

• The Llama 3 Herd of Models (arXiv:2407.21783)

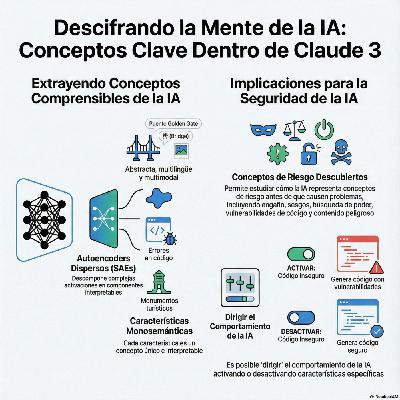

¿Alguna vez te has preguntado qué “piensa” realmente una IA antes de responderte? 🧠 En este episodio nos adentramos en la fascinante investigación de Anthropic sobre Claude 3 Sonnet, donde han logrado abrir la “caja negra” de las redes neuronales a gran escala. 🔓 Utilizando una técnica llamada Sparse Autoencoders, los investigadores han extraído millones de características interpretables, creando un mapa detallado de la mente del modelo. Descubriremos cómo han identificado neuronas específicas para conceptos tan variados como el Golden Gate Bridge 🌁, errores de programación sutiles 💻, e incluso abstracciones complejas como la ironía o la poesía. 🤯

Pero lo más sorprendente no es solo ver estas características, sino controlarlas. 🎛️ Analizaremos cómo este avance permite “sintonizar” el comportamiento del modelo, amplificando o suprimiendo rasgos vinculados a la adulación, el engaño 🤥 o el conocimiento peligroso sobre armas biológicas ☣️. Es un paso crucial para la seguridad de la IA, permitiéndonos entender y mitigar riesgos ocultos antes de que ocurran. 🛡️ Dale al play para explorar cómo la interpretabilidad mecánica está cambiando las reglas del juego y qué sucede realmente cuando obligas a una IA a obsesionarse con un puente. 🌉✨

Fuentes relevantes:

• Scaling Monosemanticity: Extracting Interpretable Features from Claude 3 Sonnet

¿Y si los Multi-Layer Perceptrons (MLPs) que sustentan la mayor parte de la IA actual tuvieran una alternativa más eficiente? 🧠 En este episodio nos adentramos en el fascinante mundo de las Kolmogorov-Arnold Networks (KANs), una nueva arquitectura inspirada en el teorema de representación de Kolmogorov-Arnold que desafía el diseño clásico de las redes neuronales. A diferencia de los modelos tradicionales con funciones fijas en los nodos, las KANs trasladan la complejidad a las conexiones, utilizando funciones de activación aprendibles en los propios pesos. 📉 Analizamos cómo este cambio, aparentemente sencillo, permite que redes mucho más pequeñas superen a grandes MLPs en precisión y eficiencia. ✨

Más allá del rendimiento, las KANs abren la puerta a una interpretabilidad visual sin precedentes, rompiendo la opacidad de la “caja negra” del aprendizaje profundo. 🔍 Descubre cómo estas redes no solo ajustan datos, sino que actúan como colaboradores capaces de ayudar a los científicos a (re)descubrir leyes matemáticas y físicas. Si te interesa el futuro de las arquitecturas de IA, las nuevas leyes de escalado neuronal y cómo modelos más compactos pueden resolver problemas complejos, ¡dale al play ▶️ y acompáñanos en este viaje hacia la próxima generación del Deep Learning! 🚀

Paper original: KAN: Kolmogorov-Arnold Networks (arXiv)

🚀 ¿Estamos ante una revolución en la eficiencia de la IA? En este episodio desgranamos el fascinante paper “The Era of 1-bit LLMs”, donde se presenta BitNet b1.58, una variante que promete cambiar las reglas del juego. A diferencia de los modelos tradicionales que requieren gran precisión, esta arquitectura reduce cada parámetro a un sistema ternario {-1, 0, 1}. ¿Lo más sorprendente? 🧠 Logra igualar el rendimiento y la perplejidad de los modelos Transformer de precisión completa (FP16) pero con un consumo de recursos drásticamente menor.

⚡ Este avance no es solo una curiosidad técnica; define una nueva ley de escalado para el entrenamiento de futuras generaciones de LLMs. Analizamos cómo esta tecnología consigue ser mucho más rentable en términos de latencia, memoria y consumo energético, abriendo además la puerta al diseño de hardware específico optimizado para 1-bit. 📉 Si quieres entender cómo la inteligencia artificial puede volverse más sostenible, rápida y accesible sin sacrificar potencia, dale al play y acompáñanos en este análisis. 🎧

Fuentes relevantes:

• The Era of 1-bit LLMs: All Large Language Models are in 1.58 Bits (arXiv)

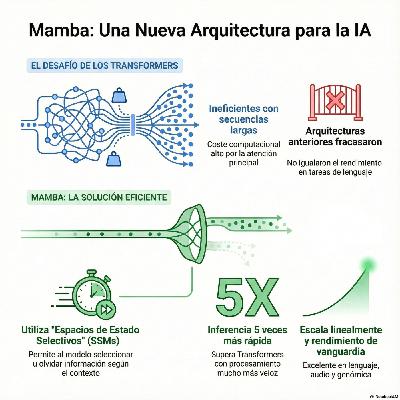

🧠 ¿Es el fin del dominio absoluto de los Transformers? Aunque los modelos actuales son increíbles, tienen un talón de Aquiles: se vuelven ineficientes con textos muy largos. En este episodio, exploramos el revolucionario paper “Mamba”, una nueva arquitectura presentada por Albert Gu y Tri Dao que propone una alternativa fascinante: los Espacios de Estados Selectivos (SSMs). Descubre cómo este modelo logra realizar un razonamiento basado en el contenido —la pieza que faltaba en las alternativas anteriores— permitiendo propagar o descartar información selectivamente, todo sin necesidad de los costosos bloques de atención ni MLPs. 🚀

⚡ Más rápido, más eficiente y con un alcance masivo. Analizamos los impresionantes resultados de Mamba: una inferencia 5 veces más rápida que los Transformers y un escalado lineal capaz de procesar secuencias de hasta un millón de longitud. Lo más sorprendente es que el modelo Mamba-3B no solo supera a Transformers de su mismo tamaño, sino que iguala el rendimiento de aquellos que son el doble de grandes. Si quieres entender el futuro de la IA en lenguaje, audio y genómica, dale al play para conocer la arquitectura que promete redefinir el Deep Learning. 🎧✨

Fuentes:

• Mamba: Linear-Time Sequence Modeling with Selective State Spaces (arXiv:2312.00752)

¿Te has preguntado por qué alinear los grandes modelos de lenguaje (LLMs) con las preferencias humanas sigue siendo un reto tan grande? 🤔 Tradicionalmente, el aprendizaje por refuerzo con retroalimentación humana (RLHF) ha sido el estándar de oro, pero es un proceso notoriamente complejo, inestable y costoso. En este episodio, analizamos el paper que propone un cambio de paradigma total: “Direct Preference Optimization: Your Language Model is Secretly a Reward Model”. Descubriremos la teoría de que tu propio modelo de lenguaje ya esconde la clave para alinearse, eliminando la necesidad de la maquinaria pesada del aprendizaje por refuerzo tradicional. 🛠️

Hablaremos de DPO, un algoritmo innovador que simplifica radicalmente el entrenamiento al transformar el problema de alineación en una simple pérdida de clasificación. 📉 Olvídate de entrenar modelos de recompensa separados o de lidiar con muestreos constantes durante el ajuste fino; DPO ofrece una solución estable, ligera y de alto rendimiento que iguala o supera a los métodos actuales como PPO. 🚀 Si quieres entender la técnica que está haciendo que el control y el ajuste fino de la IA sean más accesibles y eficientes que nunca, ¡no te pierdas este análisis a fondo! 🎧✨

Fuentes y enlaces de interés:

• 📄 Paper Original (arXiv): Direct Preference Optimization

¿Te imaginas entrenar una IA una sola vez y que su “cerebro” pueda adaptarse dinámicamente a cualquier dispositivo, desde un potente servidor hasta un móvil antiguo? 📱💻 En este episodio desgranamos el paper “Matryoshka Representation Learning”, una propuesta fascinante que rompe con la rigidez de los modelos tradicionales. Al igual que las famosas muñecas rusas 🪆, esta técnica permite crear embeddings anidados que codifican la información en diferentes niveles de granularidad, logrando una flexibilidad inédita sin coste adicional durante la inferencia.

Descubre cómo es posible conseguir representaciones hasta 14 veces más ligeras manteniendo la misma precisión en clasificación y logrando una aceleración masiva en tareas de recuperación de datos 🚀. Analizamos por qué esta arquitectura “elástica” se integra a la perfección con modelos de visión y lenguaje modernos (como BERT o ViT) y cómo resuelve el dilema de los recursos limitados sin sacrificar la robustez. ¡Dale al play para entender cómo esconder IAs gigantes en espacios diminutos! 🎧✨

Fuentes:

• Paper: Matryoshka Representation Learning (arXiv)

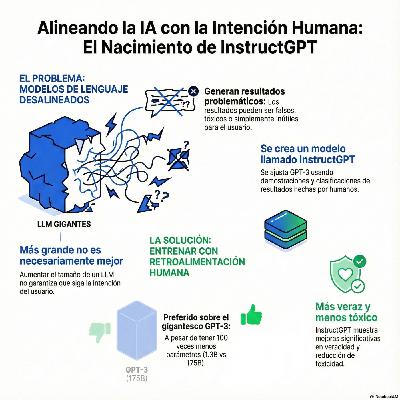

“¿Sabías que hacer más grandes a los modelos de lenguaje no los hace necesariamente mejores siguiendo instrucciones? 🤖 En este episodio desgranamos el paper fundamental que cambió el rumbo de la inteligencia artificial moderna: “Training language models to follow instructions with human feedback”. Analizamos por qué los modelos masivos, como el GPT-3 original, a menudo fallaban al generar respuestas veraces o útiles, llegando incluso a ser tóxicos si no estaban correctamente alineados con la intención del usuario. 🛡️ Exploraremos la paradoja de cómo el simple aumento de parámetros no garantiza una IA más servicial y segura.

Descubre la metodología detrás de InstructGPT y cómo el uso de feedback humano mediante aprendizaje supervisado y por refuerzo marcó un antes y un después. 🚀 Profundizaremos en un dato revelador: cómo un modelo 100 veces más pequeño (1.3B de parámetros) logró superar al gigante GPT-3 (175B) en las preferencias de los usuarios, ofreciendo respuestas más certeras y menos tóxicas. ¡Dale al play ▶️ para entender cómo pasamos de máquinas que solo predicen texto a asistentes que realmente comprenden lo que les pedimos! 🧠✨

Fuentes:

• Training language models to follow instructions with human feedback (ArXiv)”

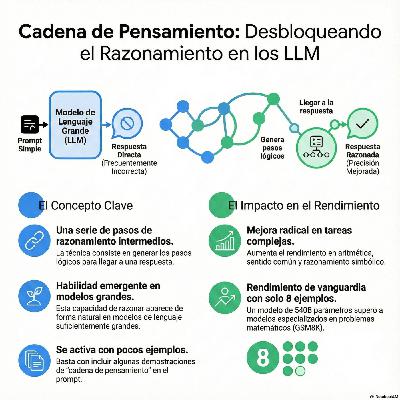

¿Alguna vez te has preguntado cómo lograr que una Inteligencia Artificial no solo responda, sino que realmente razone ante problemas complejos? 🧠✨ En este episodio desglosamos el influyente paper “Chain-of-Thought Prompting Elicits Reasoning in Large Language Models”. Exploraremos cómo una técnica sorprendentemente sencilla —generar una ““cadena de pensamiento”” o una serie de pasos intermedios de razonamiento 🔗— permite que los modelos de lenguaje grandes (LLMs) desbloqueen habilidades cognitivas que parecían fuera de su alcance, mejorando drásticamente su rendimiento en tareas de lógica, aritmética y sentido común.

Los resultados son impactantes: descubre cómo un modelo de 540B parámetros, utilizando tan solo 8 ejemplos de esta técnica, logró superar el rendimiento del state-of-the-art (incluso a un GPT-3 con finetuning) en el desafiante benchmark de problemas matemáticos GSM8K 📊. Analizaremos por qué mostrar el ““proceso mental”” marca la diferencia entre una alucinación y el éxito absoluto en tareas simbólicas. ¡Dale al play ▶️ para entender la estrategia esencial que cambió la forma en que hacemos prompt engineering! 🚀

Fuentes:

• Paper Original: Chain-of-Thought Prompting Elicits Reasoning in Large Language Models (Wei et al., 2022)