Discover Prof. Jesué - Inteligência Artificial e Governança

Prof. Jesué - Inteligência Artificial e Governança

133 Episodes

Reverse

Olá, tudo bem? Seja muito bem-vindo ao Módulo 3 do nosso curso.Hoje vamos conversar sobre um tema que está provocando debates intensos no mundo todo: os impactos éticos da Inteligência Artificial.A imagem que ilustra a capa deste módulo foi gerada por uma IA, mas inspirada em um quadro pintado por um artista humano.E aqui já surge uma questão inquietante: quem é o verdadeiro autor dessa obra?É o artista que serviu de referência ou a máquina que produziu a imagem final?Essa dúvida nos acompanhará ao longo de todo o episódio.Para começar, vamos até a China.Em um dos vídeos que compõem este módulo, uma jornalista percorre as ruas de Pequim dentro de um carro autônomo. Enquanto isso, ela comenta o ambicioso plano chinês de se tornar a maior potência mundial em Inteligência Artificial até 2030.O governo chinês investe pesado em pesquisa, desenvolvimento e incentivo a startups e grandes empresas tecnológicas.É um modelo centralizado, com forte presença do Estado, muito diferente da abordagem norte-americana, onde a inovação vem principalmente do setor privado.Empresas como Google, Microsoft, OpenAI, X e Meta ainda lideram o cenário mundial, mas a concorrência de gigantes chinesas — como Baidu, Alibaba e Tencent — cresce rapidamente.O lançamento dos modelos DeepSeek e Qwen, por exemplo, mostrou que estamos diante de uma nova corrida tecnológica.Alguns especialistas acreditam que os Estados Unidos podem perder a dianteira em áreas como IA aplicada, 5G e computação quântica, o que explica a migração de talentos para a China em busca de melhores condições de trabalho e financiamento.Mas há um outro lado dessa história.Na China, o uso da Inteligência Artificial levanta sérias questões éticas e de privacidade, principalmente por causa da vigilância em massa.Um segundo vídeo mostra uma sala de aula equipada com câmeras e sensores capazes de monitorar cada movimento dos alunos — desde as expressões faciais até os batimentos cardíacos.Esses dispositivos permitem que professores saibam, em tempo real, quem está prestando atenção e quem está distraído.A IA ajusta o conteúdo de acordo com o ritmo de cada estudante e fornece feedback instantâneo sobre o desempenho em leitura e matemática.Parece incrível, não é?Mas o preço disso pode ser alto.Críticos alertam que esse tipo de vigilância pode aumentar a ansiedade e criar um ambiente de alta pressão, especialmente entre as crianças.Por outro lado, há quem defenda que a tecnologia pode melhorar a qualidade da educação, oferecendo suporte mais rápido e eficaz para alunos com dificuldades e reduzindo a carga administrativa dos professores.Ainda assim, precisamos refletir: até que ponto o monitoramento constante é saudável?A sensação de estar sendo observado o tempo todo pode inibir a criatividade, a espontaneidade e até a autoestima dos estudantes.Em longo prazo, isso pode gerar efeitos psicológicos sérios, como ansiedade, depressão e até o medo de ser julgado a todo momento.É por isso que o equilíbrio entre tecnologia e humanidade é tão importante.Nenhum algoritmo deve substituir o papel do professor como mentor e mediador do conhecimento.Mais do que transmitir conteúdo, o educador ajuda a formar cidadãos críticos, autônomos e emocionalmente saudáveis.Essa discussão nos leva a uma pergunta essencial:Quem tem acesso aos dados coletados pela IA nas escolas?Como essas informações são armazenadas, protegidas e utilizadas?E, o mais importante, o que será feito com elas no futuro?A normalização da vigilância pode nos conduzir a uma sociedade onde a privacidade é um luxo, e a conformidade é mais valorizada que a individualidade.Isso lembra o cenário descrito por George Orwell, no clássico 1984, em que todos estão sob constante observação.

Inteligência Artificial: Entre o Espelho e o Cérebro HumanoNos últimos anos, a inteligência artificial deixou de ser tema de ficção científica para se tornar parte do nosso cotidiano. Hoje, ela escreve textos, cria imagens, corrige provas, ajuda em diagnósticos médicos e até conversa conosco como se fosse um velho conhecido. Mas, afinal, até onde vai esse poder? E o que acontece com o cérebro humano diante dessa nova parceria com as máquinas?Muita gente me pergunta se o uso constante da IA pode nos deixar mentalmente mais preguiçosos. Eu gosto de responder com uma metáfora. Imagine uma régua representando um milhão de anos de evolução humana. Se fôssemos dividir essa régua várias vezes, o tempo presente seria apenas um traço minúsculo. Toda a revolução tecnológica — da escrita ao computador, da internet à IA — cabe em uma fração ínfima dessa régua. Seria exagero pensar que três anos de ChatGPT poderiam “atrofiar” um cérebro moldado por um milhão de anos de adaptação.O cérebro humano é um sistema de espantosa plasticidade. Quando uma área é afetada, outras se reorganizam para compensar. Essa capacidade explica nossa sobrevivência e nossa criatividade. E, como toda ferramenta inventada pela humanidade, a IA apenas amplia essa capacidade — desde que saibamos usá-la com consciência.Quando a imprensa surgiu, diziam que as pessoas deixariam de memorizar. Quando o Google apareceu, afirmaram que ninguém mais saberia pensar por conta própria. E quando as calculadoras se popularizaram, os professores temeram pelo fim da tabuada. A história mostra o contrário: a cada salto tecnológico, o ser humano redefine o que é pensar.O que está em jogo agora não é a capacidade cognitiva em si, mas a forma como gerenciamos nossa atenção. A verdadeira ameaça não é a IA, mas o excesso de estímulos — vídeos curtos, notificações incessantes, algoritmos que disputam nossa dopamina a cada rolagem de tela. É um vício invisível: o prazer de receber respostas instantâneas sem esforço. Aprendemos rápido, mas esquecemos mais rápido ainda. A aprendizagem profunda exige paciência, repetição e, sobretudo, tempo.Em minhas aulas no IFSC, uso a IA como aliada — e não como substituta do raciocínio. Já vi alunos criarem, em minutos, aplicativos que antes levariam dias de programação. Vi o brilho nos olhos deles ao perceberem que podiam ser criadores, não apenas consumidores de tecnologia. Isso é o que chamo de revolução pedagógica: transformar o estudante em autor, e não em mero espectador.Nas disciplinas de Refrigeração e Climatização, costumo dizer: “O segredo não é decorar comandos, mas compreender processos.” Quando a IA me ajuda a restaurar a barra de comandos do AutoCAD ou revisar um plano de ensino, ela me libera da repetição mecânica para que eu possa ensinar o raciocínio — a essência da engenharia e da educação.Mas é preciso cuidado. As IAs generativas — como o ChatGPT, o Google Gemini e a Manus AI — ainda cometem erros. Elas “alucinam”, ou seja, inventam dados com aparência de verdade. Isso acontece porque os modelos são treinados para tentar responder a tudo, mesmo quando não sabem. Por isso, sempre digo aos meus alunos: “Não acredite cegamente. Verifique. Questione. Refaça o caminho.” O verdadeiro pensamento crítico começa na dúvida.Uso três IAs com frequência. O ChatGPT Plus, da OpenAI, é meu principal assistente para preparar aulas e revisar textos. O Gemini, da Google, tem uma versão educacional gratuita que recomendo aos professores e alunos. E a Manus AI, uma plataforma chinesa, funciona bem como terceira opinião — é interessante comparar as respostas das três e até pedir que uma avalie o trabalho da outra. É um diálogo de inteligências.

Olá, seja muito bem-vindo ao nosso episódio de hoje.Eu sou o professor Jesué, e neste episódio, quero convidar você a refletir sobre um tema que está moldando silenciosamente o nosso modo de pensar, criar e aprender: o impacto da Inteligência Artificial na cognição humana.Vivemos um tempo fascinante — e também desafiador.Nunca antes tivemos tanto acesso à informação, nem tantas ferramentas para transformar ideias em realidade. Modelos generativos, como o ChatGPT, já fazem parte do nosso cotidiano. Eles escrevem, traduzem, resumem, criam, explicam e, às vezes, até decidem por nós. Mas será que essa facilidade tem um preço?Um estudo recente do MIT, o Instituto de Tecnologia de Massachusetts, observou a atividade cerebral de estudantes enquanto escreviam textos com e sem o auxílio da IA. O resultado foi inquietante: aqueles que usaram a IA mostraram menor atividade em áreas do cérebro ligadas à atenção e à criatividade.Em outras palavras, o cérebro trabalhou menos. E isso, em longo prazo, pode significar menos estímulo para desenvolver as habilidades que nos tornam criadores e pensadores originais.A pesquisa da Microsoft, por sua vez, trouxe outro dado importante. Ao acompanhar mais de trezentos profissionais que utilizavam IA no trabalho, descobriu-se que em quase dois terços das tarefas realizadas com auxílio da máquina, não houve necessidade de pensamento crítico. As pessoas completavam suas atividades com mais rapidez — sim —, mas com menos esforço mental.É o que os neurocientistas chamam de descarregamento cognitivo, ou cognitive offloading.Nosso cérebro é programado para economizar energia. Se encontra um atalho confiável, tende a usá-lo. Quando passamos a terceirizar constantemente o raciocínio, a memória e a criatividade para uma ferramenta digital, ele se adapta — e pode começar a “desligar” certas áreas por desuso.E aqui está o dilema: quanto mais usamos a IA para pensar por nós, menos pensamos por nós mesmos.Não é que a máquina “nos torne burros”, como alguns dizem. O que acontece é mais sutil — e mais perigoso. Vamos perdendo o hábito do esforço mental, aquele pequeno desconforto que, na verdade, é o motor da aprendizagem e da originalidade.Mas há uma boa notícia: a inteligência artificial não é, por natureza, uma ameaça à inteligência humana.Tudo depende de como a usamos.Se encararmos a IA como um substituto, corremos o risco de atrofiar nossas habilidades cognitivas.Mas se a tratarmos como um co-piloto, um parceiro de raciocínio, podemos ampliar nossas capacidades.A pesquisadora Zana Buçinca, também da Microsoft, sugere uma técnica simples, mas poderosa: antes de pedir ajuda à IA, tente responder por conta própria. Formule a sua ideia, seu texto, sua hipótese. Depois, compare com a resposta da máquina. Assim, o cérebro é obrigado a participar ativamente do processo, em vez de apenas consumir o resultado.Esse tipo de prática é chamado de forçamento cognitivo — um treino intencional para manter a mente desperta, mesmo em um mundo repleto de facilidades.Podemos aplicar isso na sala de aula, no trabalho e até nas tarefas cotidianas: em vez de pedir que a IA resolva o problema, podemos pedir que ela nos ajude a pensar sobre ele.No fundo, o verdadeiro desafio da era da Inteligência Artificial não é tecnológico — é humano.Estamos aprendendo a conviver com máquinas que escrevem, falam e até raciocinam de modo convincente. Mas ainda somos nós os responsáveis por decidir como e por que usá-las.A IA pode ser uma aliada extraordinária — desde que mantenhamos o controle da curadoria humana: a capacidade de questionar, validar, criticar e escolher.Se abdicarmos disso, nos tornaremos espectadores do nosso próprio pensamento. Mas se cultivarmos a metacognição — a consciência de como pensamos —, então a IA deixará de ser um risco e se tornará um espelho poderoso do nosso potencial.

Um pouco sobre Sam Altman

Isaac Asimov: The Architect of the Three Laws and the GalaxiesIt was a cold afternoon in Brooklyn, New York, when little Isaac Asimov, just three years old, arrived in the United States with his parents — Russian immigrants in search of a better life. Born on January 2, 1920, in the small town of Petrovichi, in what was then the Soviet Union, Isaac was a curious child — and that curiosity would follow him for life, burning like an unquenchable flame within him.His parents opened a small candy store in Brooklyn, and it was there, among shelves of sweets and pulp sci-fi magazines, that Isaac taught himself to read — at the age of five. Words came naturally to him. He devoured magazines like Amazing Stories and Astounding Science Fiction while his classmates were still learning the alphabet.At school, he was brilliant and precocious. By the age of 15, he was already in college. Later, he earned a PhD in biochemistry from Columbia University. Although science was his academic career, it was through writing that he would become immortal.Asimov wrote his first science fiction story at 19. His talent caught the eye of John W. Campbell, the legendary editor of Astounding Science Fiction. From there, his literary career took off like a Foundation starship.And what a career it was! Isaac Asimov wrote or edited more than 500 books and thousands of essays and letters. He moved fluidly between science fiction, science writing, history, the Bible, Shakespeare, classical literature, and more. A true modern polymath.But it was through science fiction that he shaped the future.In the 1940s, Asimov created the Three Laws of Robotics, a set of ethical principles his intelligent machines would obey — principles that continue to inspire discussions around artificial intelligence and robotics today. 1. A robot may not injure a human being or, through inaction, allow a human being to come to harm. 2. A robot must obey the orders given it by human beings, except where such orders would conflict with the First Law. 3. A robot must protect its own existence as long as such protection does not conflict with the First or Second Law.These laws gave birth to the world of robot stories and the classic “I, Robot”, where Asimov not only created robots but also deep philosophical and moral dilemmas — exploring what it means to be conscious, ethical, and above all, human.But his grand epic came with the Foundation series — a sweeping saga that blends science, history, politics, and psychology, following the decline and rebirth of a galactic empire through the use of “psychohistory,” a fictional science capable of predicting the behavior of large populations. Inspired by Edward Gibbon and his work on the fall of the Roman Empire, Asimov transported Rome’s fall to the stars.Even with his literary fame, Asimov never abandoned science. He became a professor at Boston University and one of the greatest science communicators of the 20th century. His popular science books — like The Book of Physics, The Book of Chemistry, and The Land of Canaan — inspired generations with clear, accessible, and often humorous explanations.And he was also witty. Proud of knowing practically “everything,” he loved to say: “I don’t just believe in God — I know He’s a fan of Asimov.” Always with a sarcastic smile.Isaac Asimov died on April 6, 1992, from complications related to AIDS, contracted during a blood transfusion in a heart surgery years earlier — a fact kept secret until after his death.He passed on, but left behind an entire universe.Today, when we think of ethical robots, galactic empires, mathematical predictions of human behavior, or how to teach science with clarity and passion, we are following in Asimov’s footsteps. His ideas live on — on screens, in books, in debates about technology, and in the hearts of everyone who looks to the future and asks: “What if?”

Welcome to another episode in our series about the pioneers of artificial intelligence. Today, we’re diving into a fascinating story — one of genius, courage, and tragedy. It’s the story of Alan Turing, the man who, long before computers as we know them, dared to imagine machines capable of thinking.Imagine England in the 1930s. The radio was still the main form of communication, World War II was about to begin, and the idea of a “computer” seemed like science fiction. In this context, a brilliant, curious, and restless young man was born: Alan Mathison Turing. From a young age, Turing showed an extraordinary mind — passionate about numbers, puzzles, and the possibility that machines could one day “think.”But Turing’s name isn’t only associated with theory. He would become the man who helped change the course of history by decoding the secrets of the Enigma machine — the cryptographic system used by the Nazis during World War II. This monumental achievement not only shortened the war by years, it also saved thousands of lives.Still, what would immortalize him in the history of science was another invention: the Turing Test, proposed in 1950. A simple yet revolutionary idea: could a machine be distinguished from a human being just by having a conversation?Turing called his proposal the Imitation Game. Three participants take part in this experiment: a human, a machine, and an evaluator. The evaluator must determine who is who, based only on written responses. If the evaluator can’t tell the machine from the human, then the machine has, in a sense, passed the test — demonstrating intelligence.But to grasp the scope of this idea, we need to go further back in time. Centuries earlier, the philosopher René Descartes had already reflected on so-called “automaton machines” — mechanisms capable of responding to human stimuli. He argued that while these machines might speak and react, they would never be able to sustain a free, creative, and conscious conversation like even the simplest human being can.Turing, inspired by these ancient thoughts and his love for mathematical logic, decided to take the discussion to a new level. He didn’t just want to imagine responsive machines. He wanted to prove, scientifically, that human thought could be replicated in a logical, mathematical, programmable system.And so, among equations, algorithms, and dreams of the future, the concept that still guides much of modern artificial intelligence was born. The Turing Test wasn’t just an intellectual game — it was a philosophical mirror, an invitation to reconsider what it truly means to be intelligent.And perhaps, without realizing it, Alan Turing initiated one of the greatest adventures of the 20th century: the quest for an artificial mind.In the first part, we explored the beginnings of Alan Turing’s journey — a genius who dared to ask if machines could think. Now, let’s take a closer look at how the famous Turing Test works and why it remains a milestone in the history of artificial intelligence.For Turing, the big question wasn’t philosophical — it was practical. He didn’t ask, “Can machines think?” but rather, “Can machines fool us into thinking they do?” This subtle shift transformed an abstract debate into something testable, measurable, and observable.The test works like this: there are three participants — a human, a machine, and a human evaluator. The evaluator can neither see nor hear the other two, only read their answers on a text terminal. The evaluator asks questions — on any topic — and must decide, based on the responses, who is the machine and who is the human.If, by the end of the conversation, the evaluator cannot distinguish between the two, the machine “wins” the imitation game. Or, as we’d say today, it passes the Turing Test.This idea, proposed in 1950, was visionary.

Introdução ao N8N

Olá, tudo bem? Neste Módulo 1, vamos explorar os fundamentos da Inteligência Artificial (IA) e como você pode utilizá-la para potencializar seus estudos. Criamos um aplicativo chamado Curso IA EAD - Tutor, que foi projetado para responder às principais dúvidas sobre este curso. Nossa sugestão é que você interaja com o conteúdo: realize os exemplos propostos ao longo do texto, assista aos vídeos indicados e teste os aplicativos sugeridos.Apesar de a IA ter se tornado popular para o grande público apenas em 2022 com o lançamento do ChatGPT, a verdade é que os estudos sobre inteligência artificial começaram há mais de 70 anos.Em 1950, o matemático Alan Turing publicou um artigo chamado Computing Machinery and Intelligence. Nele, propôs o que ficou conhecido como Teste de Turing. A ideia era simples, porém revolucionária: se um computador fosse capaz de convencer uma pessoa de que está conversando com outro ser humano, ele poderia ser considerado inteligente. Esse teste se tornaria um dos marcos conceituais da IA.Ao longo das décadas, diversos pesquisadores contribuíram para o avanço da inteligência artificial. Em 1956, uma conferência reuniu nomes como John McCarthy e Marvin Minsky, lançando as bases do que hoje conhecemos como IA moderna. Desde então, jogos de tabuleiro como xadrez se tornaram um campo de testes ideal, oferecendo um ambiente controlado para experimentos com algoritmos.No entanto, a trajetória da IA não foi linear. Houve períodos de grande entusiasmo seguidos por frustrações, que ficaram conhecidos como “invernos da IA”. O primeiro deles ocorreu nos anos 1970, quando as promessas iniciais não se concretizaram por limitações técnicas. Um segundo inverno ocorreu nos anos 1980, quando o interesse e os investimentos diminuíram drasticamente.Mas a IA voltou com força total nos anos 1990. Um marco importante foi a vitória do computador Deep Blue, da IBM, sobre o campeão mundial de xadrez Garry Kasparov, em 1997. Equipado com um poderoso algoritmo de busca por força bruta, o Deep Blue era capaz de analisar cerca de 200 milhões de posições por segundo. Isso permitia ao computador prever muitos lances à frente, algo praticamente impossível para um ser humano em tão pouco tempo. Essa vitória marcou o renascimento do interesse global pela IA.Com o tempo, surgiram novas abordagens, como o aprendizado profundo, ou deep learning, que revolucionaram a área. Essa técnica utiliza redes neurais artificiais com muitas camadas, conhecidas como redes profundas. Essas redes funcionam de forma semelhante ao cérebro humano: recebem dados, processam informações e transmitem os resultados para as próximas camadas, até chegar a uma decisão ou resposta final.Durante o treinamento dessas redes, o sistema comete erros, mas aprende com eles. Esse aprendizado acontece por meio do ajuste dos chamados pesos das conexões entre os neurônios artificiais, com o uso de métodos como o backpropagation e o gradiente descendente — que servem para reduzir os erros entre o que a rede prevê e o resultado esperado.Existem diversos tipos de redes neurais, cada uma adequada a diferentes tarefas:As ANNs, ou Redes Neurais Artificiais, são mais simples e usadas para tarefas genéricas como classificação.As CNNs, ou Redes Convolucionais, são altamente eficazes em reconhecimento de imagens e vídeos.Já as RNNs, ou Redes Recorrentes, são ideais para trabalhar com dados sequenciais, como textos e séries temporais.Essas tecnologias estão por trás de assistentes de voz, sistemas de recomendação, tradutores automáticos, reconhecimento facial, entre muitas outras aplicações que já fazem parte do nosso cotidiano.Para entender isso de forma prática, imagine que você tem um álbum com milhares de fotos de gatos e cachorros. Você mostra essas imagens para o computador, que no início erra bastante ao tentar identificar o que é cada animal. Mas, com o tempo e após muitos ajustes internos, o sistema começa a acertar cada vez mais.

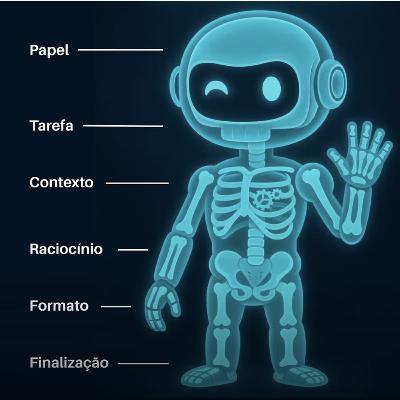

Bem-vindo ao Módulo 2 do nosso curso sobre Inteligência Artificial Generativa. Nesta etapa, vamos sair do campo teórico e caminhar pelas aplicações práticas que estão transformando a educação, a ciência, a gestão e o cotidiano das pessoas. Este módulo é um convite para imaginar, experimentar e refletir sobre como as máquinas podem colaborar com o nosso aprendizado e com o avanço da sociedade. A educação sempre foi terreno fértil para experimentações. Décadas antes do ChatGPT, um psicólogo chamado Burrhus Frederic Skinner, nascido em 1904, já sonhava com o ensino automatizado. Nos anos 1950, ele propôs que máquinas poderiam não apenas substituir os professores, mas também redefinir seus papéis, tornando-os coordenadores e gestores de um processo de aprendizagem autônomo. Em sua visão, cada estudante teria uma máquina capaz de corrigir imediatamente suas respostas — uma ideia ousada, quase visionária para a época. No entanto, as promessas de Skinner não se concretizaram. As tecnologias disponíveis eram caras e limitadas, e havia resistência da comunidade educacional. Curiosamente, o que parecia um sonho distante está ressurgindo agora, impulsionado por uma nova geração de máquinas — as Inteligências Artificiais Generativas. Hoje, a IA não é apenas uma máquina que corrige exercícios. Ela pode criar textos, imagens, vídeos, apresentações e até músicas, tudo com base em modelos complexos de redes neurais e algoritmos transformadores que aprendem com grandes volumes de dados. O professor do século XXI já pode usar essas ferramentas como parceiros criativos, transformando o processo de ensino em uma experiência mais envolvente e personalizada. Imagine uma aula de Física. O professor quer ensinar o conceito de Movimento Retilíneo Uniforme. Em vez de desenhar gráficos no quadro, ele propõe um desafio: “Vamos pedir para uma IA criar o gráfico de S = 2 + 2t”. Ao usar um assistente como o GPT Wolfram, o aluno insere o comando: “Faça um gráfico para S = 2 + 2t. Explique.” Em segundos, a IA gera o gráfico e descreve o significado físico da equação. A ferramenta explica que o movimento é linear, que a velocidade é constante e que o ponto inicial é 2. Esses resultados, que antes exigiriam um software específico de simulação, agora podem ser obtidos dentro de um simples chat. O Wolfram, um dos assistentes mais respeitados para cálculos matemáticos e físicos, está disponível gratuitamente no ChatGPT. Ele permite resolver expressões algébricas, equações diferenciais, gerar gráficos tridimensionais e até simular fenômenos científicos complexos. No entanto, é importante lembrar que, apesar do brilho da tecnologia, a IA não é infalível. Ela tenta prever a resposta que tem maior probabilidade de estar correta, mas nem sempre acerta. Por isso, o papel do professor continua sendo essencial: verificar, validar e discutir as respostas geradas pela máquina. A IA deve ser tratada como um instrumento de apoio, e não como uma fonte definitiva de verdade. Essa interação entre o ser humano e o algoritmo é, na verdade, o coração da educação contemporânea. Quando usamos a IA com criticidade, transformamos o aprendizado em um processo dinâmico e dialogado, em que o estudante deixa de ser um receptor passivo e se torna um explorador do conhecimento. O segredo está no prompt, a instrução que damos à máquina. Um bom prompt é como uma pergunta bem feita: quanto mais claro e detalhado ele for, mais precisa será a resposta. O futuro da aprendizagem digital está, portanto, na arte de perguntar bem. Saber construir prompts é como aprender a conversar com a própria inteligência das máquinas — e essa será uma das habilidades mais valiosas das próximas décadas. Após compreender o potencial da IA na sala de aula e os primeiros passos com o GPT Wolfram, entramos agora em um novo território: o das grandes inteligências artificiais globais.

Sejam bem-vindos a mais um episódio da nossa série sobre os pioneiros da inteligência artificial. Hoje, vamos mergulhar em uma história fascinante — uma história de genialidade, coragem e tragédia. É a história de Alan Turing, o homem que, muito antes dos computadores como os conhecemos, ousou imaginar máquinas capazes de pensar. Imagine a Inglaterra dos anos 1930. O rádio ainda era a principal forma de comunicação, a Segunda Guerra Mundial estava prestes a começar, e a ideia de um “computador” parecia ficção científica. Nesse cenário nasce um jovem brilhante, curioso e inquieto: Alan Mathison Turing. Desde criança, Turing mostrava uma mente fora do comum — apaixonado por números, enigmas e pela possibilidade de que as máquinas pudessem um dia “raciocinar”. Mas o nome de Turing não está apenas associado a teorias. Ele se tornaria o homem que ajudou a mudar o rumo da história, decodificando os segredos da máquina Enigma — o sistema criptográfico usado pelos nazistas durante a Segunda Guerra Mundial. Esse feito monumental não só encurtou a guerra em anos, como salvou milhares de vidas. Ainda assim, o que o tornaria imortal na história da ciência seria outra invenção: o Teste de Turing, proposto em 1950. Uma ideia simples, mas revolucionária: seria possível distinguir uma máquina de um ser humano apenas conversando com ela? Turing chamou sua proposta de O Jogo da Imitação. Três personagens participam dessa experiência: um humano, uma máquina e um avaliador. Este último precisa descobrir quem é quem, apenas com base em respostas escritas. Se o avaliador não conseguir distinguir a máquina do humano, então a máquina teria, em certo sentido, passado no teste — demonstrando inteligência. Mas, para entender a dimensão dessa ideia, precisamos voltar um pouco mais no tempo. Séculos antes, o filósofo René Descartes já havia refletido sobre as chamadas “máquinas automatas” — mecanismos capazes de responder a estímulos humanos. Ele dizia que, embora essas máquinas pudessem falar e reagir, jamais conseguiriam sustentar uma conversa livre, criativa e consciente, como faz até o mais simples dos seres humanos. Turing, inspirado por esses pensamentos antigos e por seu amor pela lógica matemática, resolveu levar essa discussão para outro nível. Ele não queria apenas imaginar máquinas que respondessem. Ele queria provar, com base científica, que o pensamento humano poderia ser reproduzido em um sistema lógico, matemático, programável. E foi assim que, entre equações, algoritmos e devaneios sobre o futuro, nasceu o conceito que, até hoje, guia boa parte da inteligência artificial moderna. O Teste de Turing não era apenas uma brincadeira intelectual — era um espelho filosófico, um convite para repensarmos o que realmente significa ser inteligente. E talvez, sem perceber, Alan Turing tenha dado início a uma das maiores aventuras do século XX: a busca por uma mente artificial. Na primeira parte, conhecemos o início da trajetória de Alan Turing — um gênio que ousou perguntar se as máquinas poderiam pensar. Agora, vamos entender melhor como funcionava o famoso Teste de Turing e por que ele continua sendo um marco na história da inteligência artificial. Para Turing, a grande questão não era filosófica — era prática. Ele não perguntava “as máquinas podem pensar?”, mas “as máquinas podem nos enganar, fazendo-nos acreditar que pensam?” Essa sutileza transformou um debate abstrato em algo que podia ser testado, medido e observado. O teste funciona assim: há três participantes — um humano, uma máquina e um avaliador humano. O avaliador não vê nem ouve os outros dois, apenas lê suas respostas em um terminal de texto. Ele faz perguntas — sobre qualquer tema — e deve decidir, com base nas respostas, quem é a máquina e quem é o humano. Se, ao final da conversa, o avaliador não conseguir distinguir os dois, a máquina “vence” o jogo da imitação. Ou, como diríamos hoje, ela passa no Teste de Turing. Essa ideia, proposta em 1950, foi visionária.

Todo mundo fala sobre inteligência artificial. Empresas anunciam que têm IA embutida em seus produtos, startups prometem soluções revolucionárias e os slogans se multiplicam: “agora com machine learning”, “agora com IA integrada”. Mas será que as máquinas realmente estão fazendo o trabalho por nós? A executiva Sol Rashidi, Chief Analytics Officer da Estée Lauder, responde com firmeza: não, ainda não estão. Por trás de cada algoritmo há pessoas — engenheiros, analistas, programadores, e estrategistas. Somos nós que treinamos os modelos, corrigimos suas falhas, alimentamos suas bases e, acima de tudo, decidimos o que é relevante, o que é ético e o que é útil. Sol costuma brincar dizendo que ninguém cresce sonhando em trabalhar com dados. Ninguém, quando criança, diz que quer ser cientista de dados. Mas, de algum modo, ela acabou nesse caminho. Iniciou sua carreira em consultorias de gestão, passou por empresas como a Royal Caribbean, Sony Music e Merck, até chegar à Estée Lauder. Em cada uma delas, a pergunta que guiava suas decisões era a mesma: como transformar dados em decisões? Segundo ela, o papel de um Chief Analytics Officer não é apenas construir relatórios e dashboards. É criar um ecossistema de inteligência, em que os dados sustentam o aprendizado da organização e se transformam em insights que movimentam o negócio. O objetivo é sempre o mesmo: gerar conhecimento capaz de antecipar tendências e orientar estratégias. Sol descreve essa atuação como um jogo ofensivo. Enquanto o Chief Data Officer é responsável pela defesa — garantindo a qualidade, segurança e integridade dos dados — o Chief Analytics Officer atua no ataque, buscando gerar valor a partir dos números. O primeiro organiza as bases. O segundo joga com elas para vencer. Mas essa vitória só acontece quando se entende que os dados não são um fim. São meios. Ferramentas. E, se não forem usados com propósito, acabam se tornando apenas um amontoado de relatórios esquecidos na prateleira — ou, como ela diz, “shelf-ware”. É por isso que, mais do que tecnologia, o verdadeiro desafio está na cultura. Porque, no fim, de nada adianta ter os melhores sistemas se as pessoas não souberem o que perguntar, nem o que fazer com as respostas. Um dos episódios mais marcantes da trajetória de Sol Rashidi aconteceu quando ela liderava um projeto para criar uma visão completa do consumidor. A proposta era integrar dados espalhados por dezenas de sistemas diferentes e, assim, compreender melhor quem eram os clientes e como se comportavam. Foram mapeadas setenta e seis fontes de informação e, dessas, vinte e uma se mostraram realmente essenciais. O resultado foi um painel unificado, moderno, atraente — um verdadeiro mapa do comportamento do consumidor. O projeto parecia um sucesso. As equipes adoraram a novidade, os executivos se entusiasmaram com a praticidade e tudo parecia funcionar perfeitamente. Mas, ao analisar os dados de forma mais profunda, a equipe de Sol descobriu algo desconcertante. Os clientes mais fiéis, aqueles que a empresa mais valorizava, os “membros de ouro”, não eram os mais rentáveis. Na verdade, em muitos casos, davam prejuízo. Ao cruzar as informações financeiras com os registros de atendimento, a equipe percebeu que esses consumidores haviam descoberto como tirar vantagem do sistema. Ligavam para diferentes centrais de atendimento, reclamavam várias vezes e conseguiam reembolsos múltiplos.

Boa noite, pessoal! Sejam muito bem-vindos a mais um episódio do nosso podcast. Mas antes de falarmos de ferramentas, prompts e aplicativos que usam Inteligência Artificial, eu quero começar com algo mais humano: uma história. Sim, eu confesso — gosto de contar histórias. Porque entender a origem da IA não é apenas sobre tecnologia, é sobre pessoas, medos e decisões que moldaram o mundo digital em que vivemos hoje. Essa história começa de forma improvável: em uma festa de aniversário. Era o aniversário de 44 anos de Elon Musk, em julho de 2015. O local? Napa Valley, Califórnia — um paraíso entre vinhedos e colinas, onde o Vale do Silício costuma celebrar suas conquistas. Naquele momento, Musk já era um homem de influência quase mítica: cofundador do PayPal, investidor da Tesla e comandante da SpaceX — empresa que já operava em parceria com a NASA. Mas havia algo que o tirava o sono: o futuro da Inteligência Artificial. Musk via na IA o mesmo potencial dual que um dia a humanidade encontrou na energia nuclear — uma força capaz de iluminar cidades, mas também de destruir civilizações. Essa preocupação não era mero capricho. Ele já havia investido milhões na DeepMind, uma empresa inglesa de IA que treinava sistemas capazes de aprender sozinhos, jogando videogames e vencendo humanos em tarefas cognitivas complexas. Porém, em 2014, o Google comprou a DeepMind — vencendo uma disputa feroz com o Facebook. E o detalhe é que, para conseguir o negócio, o Google aceitou uma condição pouco comum: a de nunca usar as descobertas da empresa para fins militares. Musk, desconfiado, não gostou do rumo. Ele propôs a criação de um comitê de ética para fiscalizar os avanços em IA — mas sua sugestão foi ignorada. Na festa de aniversário, cercado por empresários e cientistas brilhantes, Musk travou um debate acalorado com Larry Page, cofundador do Google. Page argumentava que, se a inteligência artificial superasse a humana, isso seria apenas uma continuação natural da evolução — afinal, o progresso sempre segue em frente. Musk discordava. Ele acreditava que a IA precisava de limites éticos, ou poderia sair do controle. Daquele diálogo, entre taças de vinho e egos gigantes, nasceu uma ideia perigosa — e necessária. Musk decidiu agir. Duas semanas depois, em um jantar discreto no luxuoso hotel Rosewood, no coração do Vale do Silício, Musk reuniu um grupo de mentes brilhantes: Sam Altman, Greg Brockman e Ilya Sutskever — nomes que mais tarde se tornariam sinônimos de inovação em IA. Ali, entre pratos de massa e discussões sobre o destino da humanidade, eles firmaram um pacto: criar uma organização aberta, transparente e ética dedicada a desenvolver inteligência artificial para o bem coletivo. E assim nasceu a OpenAI — uma instituição sem fins lucrativos, cujo propósito era garantir que os avanços da IA fossem acessíveis a todos e servissem à humanidade, não apenas a grandes corporações. O que começou como um ato de inquietação pessoal se transformaria em uma das revoluções tecnológicas mais importantes do século. A partir daí, a corrida pela inteligência artificial tomaria um rumo novo — com sonhos, conflitos, descobertas e dilemas morais que ainda estamos aprendendo a enfrentar. Mas essa é apenas a primeira parte da nossa história. Agora vamos ver como a OpenAI se ergueu diante de gigantes como o Google e a Meta, e como um simples modelo de linguagem — o GPT — começou a mudar o jeito como o mundo escreve, conversa e pensa. Depois daquela reunião no Rosewood, o grupo liderado por Elon Musk e Sam Altman iniciou uma jornada ambiciosa. A OpenAI nascia com um ideal quase utópico: democratizar a inteligência artificial. O objetivo não era ganhar dinheiro, e sim garantir que o poder da IA não ficasse restrito às grandes corporações. Mas logo o sonho encontrou a realidade. Desenvolver IA é algo caro — muito caro. Era preciso poder de processamento, cientistas, linguistas, engenheiros de software, matemáticos e uma estrutura gigantesca.

Sejam muito bem-vindos a mais um episódio do nosso podcast sobre Inteligência Artificial e Educação. Hoje o tema é fascinante — e um tanto desafiador: como a IA está transformando o nosso cotidiano e, principalmente, como nós, educadores, podemos usá-la de maneira consciente e ética. Talvez você ainda não tenha se dado conta, mas a inteligência artificial já faz parte da sua vida há mais de uma década. Ela está presente quando você diz “Ei, Siri”, “Ok, Google” ou conversa com a Alexa para ajustar a temperatura da casa. Essas assistentes virtuais são exemplos vivos do poder das redes neurais, sistemas que aprendem com milhares de horas de gravações humanas para transformar nossa voz em comandos precisos. E quer saber? A IA também está lá, discretamente, quando você abre a Netflix ou o Spotify. Essas plataformas analisam o que você assistiu ou ouviu e sugerem novos conteúdos com base nos seus gostos. Claro, nem sempre acertam, mas essa capacidade de personalização é o coração da inteligência artificial: entender padrões e antecipar preferências. O mais interessante é que, embora o ChatGPT tenha popularizado o tema a partir de 2022, a IA já vinha amadurecendo muito antes disso. A diferença é que agora ela se tornou acessível, e isso muda tudo — especialmente para quem ensina. Na área da saúde, por exemplo, a IA já colabora com diagnósticos complexos. Hoje há sistemas capazes de detectar câncer com precisão igual — ou até superior — à de médicos experientes. E na educação, a revolução é silenciosa, mas profunda. A Khan Academy lançou o Khanmigo, um tutor digital que estimula o raciocínio dos alunos, faz perguntas provocativas e se adapta ao ritmo de aprendizagem de cada estudante. Nada de respostas prontas. A IA, nesse caso, atua como um mentor inteligente, não como um atalho. Outro exemplo interessante é o aplicativo “Como eu aprendo melhor”, que criamos aqui no nosso curso de Inteligência Artificial no Câmpus São José. Ele ajuda o professor a identificar rapidamente os estilos de aprendizagem de cada aluno — visual, auditivo, cinestésico ou leitor-escritor — e adaptar os materiais conforme essas diferenças. Pense comigo: preparar aulas personalizadas para trinta alunos é praticamente inviável com a carga horária que temos. Mas com IA, podemos transformar um mesmo conteúdo em quatro formatos diferentes, gastando o mesmo tempo. Isso não significa substituir o educador — significa ampliar seu alcance e sua sensibilidade pedagógica. É importante entender também que dar aula para diferentes públicos exige diferentes linguagens. Quem leciona no PROEJA sabe que a abordagem precisa ser mais contextualizada e prática, enquanto um curso técnico ou uma engenharia demandam maior densidade teórica. A inteligência artificial pode ajudar o professor a reconhecer essas nuances e preparar os conteúdos mais adequados para cada grupo. E há outro uso nobre da IA: o aprendizado sobre ela mesma. Nós, professores, podemos usar ferramentas como o Educação com IA, um ambiente em que o docente aprende sobre inteligência artificial fazendo perguntas do dia a dia — e recebe respostas contextualizadas, que ajudam a construir o chamado letramento em IA. Mas é claro que nem tudo é encantamento. Precisamos falar dos riscos e das preocupações que acompanham esse novo mundo. Uma delas é a autonomia cognitiva. Se o estudante — ou até nós, professores — passamos a depender demais da IA para pensar, corremos o risco de enfraquecer habilidades essenciais como o pensamento crítico e a resolução de problemas. Outra é a privacidade. Ainda não temos clareza sobre como as empresas usam os dados coletados para treinar seus modelos. E há o impacto no mercado de trabalho: profissões criativas, como design e publicidade, estão sendo redesenhadas. Uma agência que antes contratava dez designers pode hoje precisar de cinco — desde que saibam operar ferramentas de IA.

A inteligência artificial já faz parte do nosso cotidiano, mesmo quando não percebemos. Assistentes virtuais como Siri, Alexa e Google Assistente utilizam redes neurais para entender comandos de voz, interpretar perguntas e fornecer respostas de forma natural.Esses sistemas foram treinados com milhares de horas de áudio, permitindo que transformem sons em palavras com alta precisão. Outro exemplo bastante presente são os sistemas de recomendação utilizados por plataformas como Netflix e Spotify, que analisam padrões de comportamento para sugerir filmes, músicas ou séries com base nos gostos pessoais de cada usuário. Na área da saúde, a IA está fazendo avanços significativos. O sistema Watson, da IBM, já foi utilizado para diagnóstico de doenças como o câncer, com precisão comparável — e por vezes superior — à de médicos humanos. Algoritmos de IA conseguem analisar exames de imagem, como mamografias, detectando tumores em estágios iniciais e aumentando as chances de tratamento eficaz. Na educação, estão sendo realizados experimentos para personalizar o ensino conforme o estilo de aprendizagem de cada estudante. Um exemplo é o Khanmigo, assistente de IA da Khan Academy, que funciona como um tutor inteligente, ajudando os alunos sem entregar respostas prontas, mas estimulando o raciocínio e o pensamento crítico. Nesse contexto, foi desenvolvido o aplicativo GPT “Como eu aprendo melhor”, que permite identificar rapidamente o estilo de aprendizagem de cada pessoa. A partir disso, é possível preparar conteúdos personalizados, otimizando o processo de ensino-aprendizagem. Esse é um bom exemplo de como a IA pode ampliar a capacidade dos professores, permitindo que eles adaptem as aulas às necessidades específicas de cada turma. Em vez de substituir o professor, a IA atua como uma ferramenta complementar, oferecendo apoio e expandindo as possibilidades de ensino. Com a popularização de ferramentas como o ChatGPT, milhões de pessoas passaram a experimentar as potencialidades da IA. Isso gerou entusiasmo, mas também levantou preocupações relevantes, como: A perda de autonomia cognitiva (ou seja, depender demais da IA para pensar e resolver problemas); Questões de privacidade e segurança de dados; O risco de substituição de profissões por sistemas automatizados. Ao mesmo tempo em que facilita tarefas, a IA pode reforçar desigualdades sociais e educacionais, especialmente em contextos onde o acesso à tecnologia é limitado. Por isso, é fundamental refletir sobre como e para que estamos utilizando essas tecnologias. Usar IA de maneira crítica e ética é uma habilidade essencial no mundo atual. A IA também pode apresentar vieses — ou seja, agir de maneira preconceituosa ou excludente — caso seja treinada com dados incompletos ou enviesados. Um exemplo simples: ao pedir que um sistema gere a imagem de uma “pessoa inteligente trabalhando com tecnologia”, o resultado pode refletir estereótipos sociais, como representar sempre uma pessoa branca, do sexo masculino, em um escritório moderno. Esse tipo de padrão precisa ser constantemente revisado. Para experimentar esse tipo de aplicação, o curso recomenda o uso do GPT IMAGE GENERATOR. Ele permite criar imagens personalizadas com base em descrições detalhadas. É uma ferramenta útil para educadores, designers instrucionais e estudantes que desejam ilustrar conteúdos ou simular situações didáticas. Além disso, aplicativos como o GPT “Educação com IA” foram desenvolvidos com o objetivo de explicar conceitos técnicos e complexos em linguagem simples. Assim, até mesmo quem não tem formação em tecnologia pode compreender os fundamentos da IA. Encerrando esta parte, é importante reforçar que, embora os algoritmos sejam impressionantes, eles não compreendem o mundo como nós. A IA não pensa, não sente, não tem consciência. Ela apenas processa grandes quantidades de dados, identifica padrões e retorna probabilidades.

Quando a porta da sala se fecha e as luzes diminuem, a aula começa como quem acende uma fogueira. As sombras dançam nas paredes — slides, gráficos, recortes de notícias — e por um instante todos nós nos confundimos com as formas que projetamos. É nesse cenário comum, tão contemporâneo, que a velha história de Platão volta a ganhar corpo. No vídeo “O Lado Sombrio da Educação (Que Ninguém Te Contou) — Platão”, a narrativa propõe que educar é mais do que despejar conteúdos: é girar a alma inteira, reorientar o olhar, fazer o estudante virar o rosto em direção à luz. Mas, como toda fogueira, a mesma chama que aquece também pode queimar. O filme nos conduz por essa tensão: a educação como iluminação e, ao mesmo tempo, como engenharia social.A jornada começa na caverna. Platão não descreve apenas uma metáfora elegante; ele nos entrega um mapa de transformação. Aprender, nessa chave, é um verbo que exige o corpo todo: os olhos precisam acostumar-se à claridade, a mente precisa suportar o desconforto de ver aquilo que não queria ver, e o coração precisa admitir que a familiaridade das sombras não é o mesmo que a verdade. Em linguagem de sala de aula, significa que decorar fórmulas não basta: a missão é elevar a consciência, ligar pontos, ver o que sustenta os fenômenos. Essa ambição é bela e necessária. Sem ela, a educação se torna um teatro repetitivo; com ela, vira um ofício de libertação. O vídeo nos lembra que “ensinar a alma a voltar-se para a luz” exige tempo, método e coragem — inclusive a coragem de duvidar de si mesmo.Ao lado do ideal, porém, Platão ergue um edifício muito específico de formação. O famoso “programa de seleção” não era um convite democrático para todos escalarem a mesma montanha, mas um funil rigoroso, desenhado para encontrar poucos que, ao final, governariam. Primeiro, moldam-se as emoções por meio de mitos e música — e aqui a palavra “censura” aparece sem rodeios, porque quem define as histórias define o horizonte do desejável. Depois, disciplina-se o corpo pela ginástica, não para medalhas, mas para que o corpo obedeça à razão. Em seguida, treina-se o pensamento com matemática, essa linguagem que aponta para o permanente, para além dos caprichos dos sentidos. Por fim, no cume, a dialética, a arte perigosa de questionar tudo em busca do Bem. É irresistível notar o paradoxo: a etapa mais alta, a do questionamento livre, era reservada a pouquíssimos. O que é libertação para uns se converte em contenção para muitos. O vídeo acerta o tom ao mostrar que a mesma escada que leva à luz é vigiada por porteiros zelosos.É então que a narrativa mergulha no que chama de lado sombrio. Não se trata de pintar Platão como vilão, mas de encarar a arquitetura política embutida no seu projeto. A “mentira nobre” — o mito dos metais — não era um capricho literário; era um mecanismo de estabilidade social. Se todos acreditam que nasceram com uma liga diferente na alma, aceitaremos melhor que uns governem e outros obedeçam. Some-se a isso o controle da imaginação pública — a triagem do que pode ou não pode ser cantado e lido — e um arranjo de vida para a elite guardiã sem propriedade nem família, dedicada ao Estado. O resultado é uma educação que forma consciências, sim, mas as forma dentro de moldes bem apertados. Para muitos, isso soa como prevenção contra a corrupção e a demagogia. Para outros, é o germe do paternalismo: em nome do Bem, o Estado decide quem pode perguntar e quem deve calar.A crítica ganha atualidade quando o vídeo aproxima essa herança do nosso sistema moderno. A promessa contemporânea — “estude, tire um diploma, e será livre” — funciona como nova narrativa fundadora. Não é falsa no sentido trivial, porque a educação de fato amplia horizontes, renda e voz; mas é incompleta quando é vendida como único bilhete para a dignidade. As provas, vestibulares e concursos, por sua vez, desempenham o papel de portais que filtram, legitimam e organizam o acesso ao poder econômico e simbólico.

Maquiavel, o florentino tantas vezes mal lido, não ensina maldade; ensina governo. Chama de virtù a mistura de lucidez, coragem e disciplina para enfrentar a fortuna — o acaso que nos testa. A indiferença que proponho não é apatia; é estratégia: escolher quando sentir, quando falar e quando partir. No jogo do poder — aqui, o poder de dirigir a própria vida — importar-se cedo demais e para quem não merece é entregar as chaves do seu castelo antes de erguer a ponte.Pense nas vezes em que você explicou, explicou, e perdeu respeito. Quem busca controlá-lo não quer compreensão, quer mapa e senha. Maquiavel lembraria que não se governa desnudo: há coisas que se revela por vantagem e outras que se protege por prudência. Clareza, não carência. Fronteiras, não muralhas emocionais. E silêncio como instrumento: ausência bem colocada corta mais fundo que qualquer réplica.Descendo à prática. Cena 1: reunião com interrupções. A reação comum é disputar o microfone; a eficaz é ritualizar seu espaço. Pausa, registro da interrupção, retomada firme: “Termino em dois minutos; depois te escuto.” Na ata, o combinado. Sem voz elevada, você não subiu o tom; subiu o padrão. Cena 2: negociação com chantagem de urgência. Raposa para ver a armadilha, leão para encerrar a cena. Uma única explicação objetiva (escopo, risco, entrega) e a âncora: “Se faz sentido, seguimos; se não, tudo bem.” Fim. Silêncio que diz: sua atenção não está à venda.Cena 3: relações que sangram devagar — amizades de conveniência, parcerias que só existem quando você doa. Higiene emocional não é crueldade. Comunica-se o limite com serenidade. Persistiu o desrespeito, encerra-se sem dossiê nem textão. Sair em diagonal, sem plateia, é governo de si. Queimar pontes fica para quando invadem; fechar portas basta quando você decide viver em paz.“E a empatia?” A pergunta é justa. Nem todo silêncio é força; às vezes, falar é responsabilidade. Há laços em que vulnerabilidade constrói confiança. O erro não é ser bom; é ser bom sem fronteiras. O ponto maquiavélico — no bom sentido — é a bondade deliberada: explicar com nitidez uma vez, agir depois; transparência orientada por propósito, não exposição gratuita.Mais bolso, menos slogan. Mensagens fora de hora? Responda com gentileza uma vez; na segunda, estabeleça janela de resposta; na terceira, mantenha o padrão. Ritmo é poder: quem não controla a cadência perde o reino. Provocação em rede? “Não alimento discussões improdutivas.” E silêncio. Disputa de prioridades? Critérios públicos: impacto, custo, risco, reversibilidade. “Entrou em três, entra agora; do contrário, próxima iteração.” Troque brados por método. Se pedirem “mais explicações”, devolva a régua: “Mudo com evidências.”Atenção: reserva não é ressentimento. Reserva é domínio da fala; ressentimento é veneno de palavra engolida. A indiferença estratégica produz espaço: para escolher batalhas, cultivar reciprocidade, alocar energia onde rende. Sim, haverá rótulos: frio, distante, duro. É o preço de mudar a gramática das relações. Passada a poeira, quem quer construir ajusta o passo; quem vivia da sua disponibilidade procura outro anfitrião. Falar menos passa a valer mais; aparecer pouco passa a mover mais.Qual métrica usar? Paz operacional: calendário respirável, conversas sem humilhação, decisões por critério, sono sem vigias internos. Se a paz cresce, a estratégia funciona; se some, você voltou a negociar com o caos. Faça um pacto executável: explique uma vez (no máximo duas, mais curto), e aja; responda na cadência que você escolhe; invista afeto onde há retorno observável; só volte onde houver reparação concreta; escreva três critérios de prioridade e use-os como bússola; encerre sem alarde quando preciso — portas fecham melhor do seu lado.Conflitos existem, e há momentos em que confrontar é dever cívico ou ético. Também há perdas inevitáveis. Nem toda saída é vitória, nem toda permanência é covardia.

Ensaio de apresentação sobre IA a ser realizada no campus Canoinhas

https://youtu.be/OMUCNSzaHwU

https://youtu.be/DlUnzo6xzZU

Para saber mais acesse:

https://bibliotecadigital.ufrgs.br/bitstream/handle/10183/276722/001206946.pdf?sequence=1

ETHOSCOOL: AVANÇANDO A ÉTICA EM IA NA EDUCAÇÃO POR MEIO DE AGENTES MORAIS ARTIFICIAIS