Podlodka #439 – Как рассуждают LLM

Update: 2025-08-26 3

3

Description

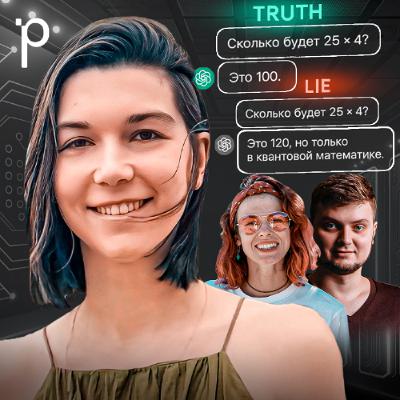

Один из главных вау-эффектов текущего поколения LLM – когда ты впервые видишь, как AI рассуждает перед тем, как выдать ответ на сложный вопрос. Чтобы разобраться с тем, что происходит у таких моделей под капотом, как их обучают и верифицируют результаты работы, мы пригласили Евгения Никишина, исследователя из OpenAI, работающего над масштабированием reasoning моделей и test-time compute.

Также ждем вас, ваши лайки, репосты и комменты в мессенджерах и соцсетях!

Telegram-чат: https://t.me/podlodka

Telegram-канал: https://t.me/podlodkanews

Страница в Facebook: www.facebook.com/podlodkacast/

Twitter-аккаунт: https://twitter.com/PodcastPodlodka

Ведущие в выпуске:

Катя Петрова, Егор Толстой

Полезные ссылки:

Личный сайт Жени

https://evgenii-nikishin.github.io/

Learning to reason with LLMs

https://openai.com/index/learning-to-reason-with-llms/

Бумага “The Illusion of Thinking” от Apple

https://machinelearning.apple.com/research/illusion-of-thinking

DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning

https://arxiv.org/abs/2501.12948

Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

https://arxiv.org/abs/2201.11903

Также ждем вас, ваши лайки, репосты и комменты в мессенджерах и соцсетях!

Telegram-чат: https://t.me/podlodka

Telegram-канал: https://t.me/podlodkanews

Страница в Facebook: www.facebook.com/podlodkacast/

Twitter-аккаунт: https://twitter.com/PodcastPodlodka

Ведущие в выпуске:

Катя Петрова, Егор Толстой

Полезные ссылки:

Личный сайт Жени

https://evgenii-nikishin.github.io/

Learning to reason with LLMs

https://openai.com/index/learning-to-reason-with-llms/

Бумага “The Illusion of Thinking” от Apple

https://machinelearning.apple.com/research/illusion-of-thinking

DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning

https://arxiv.org/abs/2501.12948

Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

https://arxiv.org/abs/2201.11903

Comments

In Channel