Discover Seventy3

Seventy3

545 Episodes

Reverse

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。合作邮箱:zhiwudazhanjiangshi#gmail.com今天的主题是:Scaling Small Agents Through Strategy AuctionsSummary小语言模型正日益被视为实现智能体 AI(Agentic AI)的一种极具前景且成本效益高的方法,支持者认为它们足以胜任智能体工作流。然而,虽然小型智能体在简单任务上能与大型智能体平分秋色,但目前尚不清楚其性能如何随任务复杂度的增加而变化、何时必须使用大模型,以及如何更好地利用小型智能体处理长时程工作负载。在本研究中,我们通过实证展示了小型智能体在深度搜索和编程任务上的性能无法随任务复杂度同步提升。为此,我们引入了 SALE(基于工作负载效率的策略拍卖),这是一个受自由职业者市场启发的智能体框架。在 SALE 中,智能体通过简短的战略计划进行投标,这些计划由系统的“成本-价值”机制评分,并通过共享的拍卖记忆进行完善,从而实现逐任务路由(Per-task Routing)和持续自我改进,而无需训练专门的路由模型或运行所有模型直至结束。在不同复杂度的深度搜索和编程任务中,SALE 将对最大智能体的依赖降低了 53%,总成本降低了 35%,并始终优于最大智能体的 Pass@1 表现,且除执行最终轨迹外,其开销几乎可以忽略不计。相比之下,现有的依赖任务描述的路由器要么性能不如最大智能体,要么无法降低成本(通常两者兼有),凸显了它们与智能体工作流的适配性极差。这些结果表明,虽然小型智能体可能不足以独立处理复杂负载,但可以通过协调的任务分配和推理时(Test-time)自我改进来有效“扩展”。更广泛地说,这激发了对智能体 AI 的系统级视角:性能提升不再仅仅源于不断增大的单个模型,而是更多地源于受市场启发的协调机制,将异构智能体组织成高效、自适应的生态系统。原文链接:https://arxiv.org/abs/2602.02751

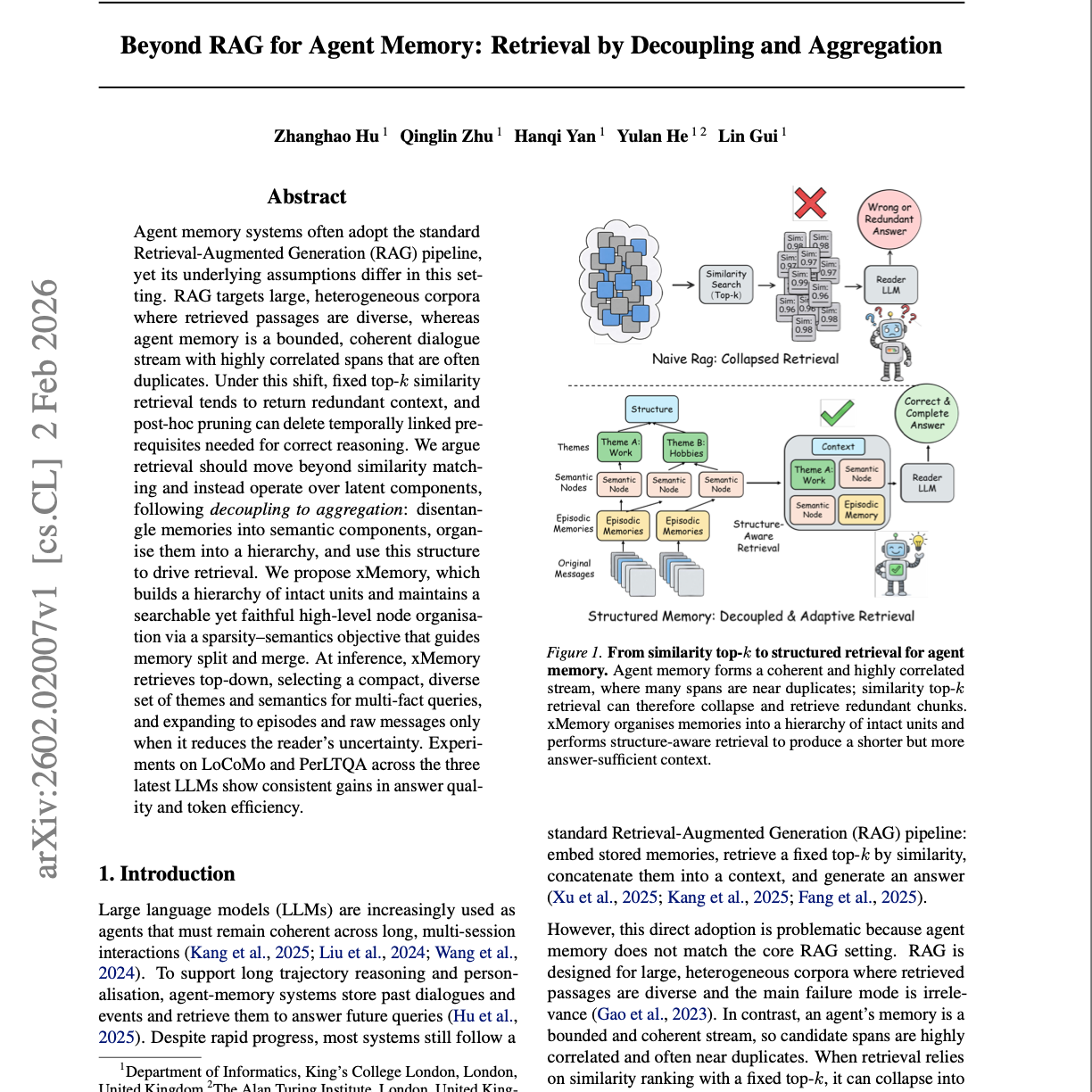

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。合作邮箱:zhiwudazhanjiangshi#gmail.com今天的主题是:Beyond RAG for Agent Memory: Retrieval by Decoupling and AggregationSummary智能体记忆系统通常采用标准的检索增强生成(RAG)流水线,但其底层假设在此场景下已发生变化。RAG 针对的是大型异构语料库,检索到的片段具有多样性;而智能体记忆是一个有界的、连贯的对话流,其中高度相关的跨度往往是重复的。在这种转变下,固定的 Top-k 相似度检索容易返回冗余上下文,而事后修剪可能会删除正确推理所需的、具有时间连续性的先决条件。我们认为,检索应当超越相似度匹配,转而在潜分量(Latent Components)上运行,遵循“解耦到聚合”的逻辑:将记忆拆解为语义分量,将其组织成层级结构,并利用该结构驱动检索。我们提出了 xMemory,它构建了一个完整单元的层级结构,并通过“稀疏性-语义”目标函数引导记忆的拆分与合并,从而维持一个可搜索且忠实的高层节点组织。在推理阶段,xMemory 执行自顶向下的检索,为多事实查询选择精简且多样的主题与语义,并仅在能降低阅读器不确定性时才扩展至具体的片段(Episodes)和原始消息。在 LoCoMo 和 PerLTQA 基准测试中,针对三种最新大语言模型的实验表明,该方法在答案质量和 Token 效率上均有显著提升。原文链接:https://arxiv.org/abs/2602.02007

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。合作邮箱:zhiwudazhanjiangshi#gmail.com今天的主题是:Learning to Reason in 13 ParametersSummary最近的研究表明,语言模型可以通过强化学习(RL)学会“推理”。虽然部分研究采用低秩参数化来实现推理能力,但传统的 LoRA 无法将秩降低到模型维度以下。我们质疑:即便秩为 1(Rank=1)的 LoRA 是否也是学习推理所必需的?为此,我们提出了 TinyLoRA。这是一种能将低秩适配器(Adapters)缩减至仅有一个参数规模的方法。在这一全新的参数化框架下,我们仅通过训练 13 个 bf16 格式的参数(总计 26 字节),就能使 8B 规模的 Qwen2.5 模型在 GSM8K 测试集上达到 91% 的准确率。我们发现这一趋势具有普适性:在 AIME、AMC 和 MATH500 等一系列更具挑战性的“学习推理”基准测试中,我们仅需训练少 1000 倍的参数,即可恢复 90% 的性能提升。值得注意的是,这种极强的性能表现仅能通过强化学习(RL)实现:使用有监督微调(SFT)训练的模型,若要达到相同的性能水平,所需的参数更新量要比前者大 100 到 1000 倍。原文链接:https://arxiv.org/abs/2602.04118

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。合作邮箱:zhiwudazhanjiangshi#gmail.com今天的主题是:Semi-Autonomous Mathematics Discovery with Gemini: A Case Study on the Erdős ProblemsSummary我们展示了一项关于半自动数学发现的案例研究,利用 Gemini 对 Bloom 的“埃尔多斯问题”(Erdős Problems)数据库中 700 个标记为“未解决”(Open)的猜想进行了系统评估。我们采用了混合方法论:首先通过 AI 驱动的自然语言验证来缩小搜索空间,随后由人类专家评估其正确性与新颖性。我们处理了数据库中标记为“未解决”的 13 个问题:其中 5 个通过看似新颖的自主解法完成,另外 8 个则通过识别现有文献中的既有解法完成。我们的研究结果表明,这些问题的“未解决”状态更多是因为其冷僻程度而非难度。此外,我们还识别并讨论了在大规模应用 AI 处理数学猜想时出现的问题,重点指出了文献检索的困难以及 AI 存在“潜意识剽窃”的风险。最后,我们对 AI 辅助攻克埃尔多斯问题的经验教训进行了反思。原文链接:https://arxiv.org/abs/2601.22401

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你想要解读自己的论文,获得更多曝光度。请联系小助手微信:seventy3_podcast 加群。合作邮箱:zhiwudazhanjiangshi#gmail.com今天的主题是:Self-Improving Pretraining: using post-trained models to pretrain better modelsSummary确保大语言模型生成内容的安全性、事实性及整体质量是一项严峻挑战,尤其是在这些模型日益广泛应用于现实场景的背景下。目前解决这些问题的主流方法是收集昂贵且精心策划的数据集,并进行多阶段的微调与对齐。然而,即便采用如此复杂的流程,也无法保证能彻底纠正模型在预训练阶段习得的模式。因此,在预训练阶段解决这些问题至关重要,因为预训练塑造了模型的核心行为,并能从源头上防止不安全或幻觉输出的根深蒂固。为了应对这一挑战,我们提出了一种全新的预训练方法:通过流式处理文档,并利用强化学习(RL)在每一步优化后续生成的 K 个 Token。该方法引入一个强大的后验模型,对包括模型预测序列(Rollouts)、原始后缀及重写后缀在内的候选生成内容进行评分,评估其质量、安全性与事实性。在训练初期,该过程依赖于原始和重写的后缀;随着模型能力的提升,强化学习将奖励高质量的模型预测序列。这种方法从底层构建了更高质量、更安全且更具事实性的模型。实验表明,与标准预训练相比,我们的方法在事实性和安全性方面分别带来了 36.2% 和 18.5% 的相对提升,在整体生成质量的胜率上最高提升了 86.3%。原文链接:https://arxiv.org/abs/2601.21343

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Reinforcement Learning via Self-DistillationSummary大型语言模型越来越多地在可验证领域(如代码与数学)中通过强化学习后训练。然而,当前用于具有可验证奖励的强化学习(RLVR)的方法通常只从每次尝试得到的单一标量结果奖励中学习,从而造成了严重的信用分配(credit assignment)瓶颈。事实上,许多可验证环境能够提供丰富的文本反馈,例如运行时错误信息或评测器(judge)的评估,这些反馈可以解释一次尝试为何失败。我们将这一设定形式化为具有丰富反馈的强化学习(reinforcement learning with rich feedback),并提出 Self-Distillation Policy Optimization(SDPO)。该方法能够在无需外部教师模型或显式奖励模型的情况下,将token 化的反馈转化为密集的学习信号。SDPO 将当前模型在给定反馈条件下的输出视为一种自教师(self-teacher),并把其基于反馈生成的下一 token 预测蒸馏回策略模型中。通过这种方式,SDPO 利用模型在上下文中事后识别自身错误的能力来进行学习。在科学推理、工具使用以及 LiveCodeBench v6 上的竞赛编程任务中,SDPO 相较于强基线 RLVR 方法,在样本效率和最终准确率方面均取得了提升。值得注意的是,在仅返回标量反馈的标准 RLVR 环境中,SDPO 仍然优于基线方法,因为它能够利用成功的 rollout 作为对失败尝试的隐式反馈。最后,当在测试时对单个问题应用 SDPO时,该方法还能加速在困难的二值奖励任务中的解发现过程:与 best-of-k 采样 或 多轮对话策略相比,SDPO 仅需 约三分之一的尝试次数就能达到相同的解发现概率。原文链接:https://arxiv.org/abs/2601.20802

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:VibeTensor: System Software for Deep Learning, Fully Generated by AI AgentsSummaryVIBETENSOR 是一个用于深度学习的开源研究型系统软件栈,由 LLM 驱动的编程智能体在人类高层指导下生成。在本文中,“完全生成(fully generated)”指的是代码来源:实现变更由智能体提出补丁(diff)并应用;验证则依赖智能体执行的构建、测试以及差异检查,而不是对每一次变更进行人工逐条审查。该系统实现了一个 类 PyTorch 的即时执行(eager)张量库:核心使用 C++20(CPU + CUDA) 实现,并通过 nanobind 提供一个 类似 torch 的 Python 封装层,同时还包含一个实验性的 HTTP URL 接口。不同于仅提供薄封装(thin bindings)的方案,VIBETENSOR 还包含: 自有的 tensor / storage 系统 schema-lite 调度器(dispatcher) 反向模式自动求导(reverse-mode autograd) CUDA 运行时组件(streams / events / graphs) 一个按 stream 顺序工作的缓存分配器,并带有诊断功能 一个稳定的 C ABI,用于动态加载算子插件我们将这一发布视为 AI 辅助软件工程的一个里程碑:它表明编程智能体能够生成一个结构连贯的深度学习运行时系统,其范围从语言绑定一直延伸到 CUDA 内存管理,并主要通过构建和测试完成验证。本文介绍了系统架构,总结了用于生成和验证该系统的工作流程,并对该工件进行了评估。我们报告了代码仓库规模与测试套件组成,并总结了来自一个AI 生成的内核套件的可复现微基准测试结果,其中包括 融合注意力(fused attention) 与 PyTorch 的 SDPA / FlashAttention 的对比。此外,我们还报告了在 NVIDIA H100(Hopper,SM90) 与 Blackwell 级 GPU 上进行的三个小规模端到端训练任务的基本可行性测试(sequence reversal、ViT、miniGPT)。多 GPU 结果仅在 Blackwell 平台上提供,并使用一个可选的基于 CUTLASS 的 ring-allreduce 插件,该插件需要 CUDA 13+ 与 sm103a 工具链支持。最后,我们讨论了在生成式系统软件中可能出现的失败模式,其中包括一种被称为 “Frankenstein 组合效应” 的问题:即多个在局部上正确的子系统组合在一起时,可能导致整体性能表现不佳。原文链接:https://arxiv.org/abs/2601.16238

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:How AI Impacts Skill FormationSummaryAI 辅助在各类专业领域中带来了显著的生产力提升,尤其对新手从业者更为明显。然而,这种辅助如何影响人们发展有效监督 AI 所需的技能,目前仍不清楚。对于需要完成不熟悉任务的新手来说,如果过度依赖 AI,可能会在这一过程中削弱自身的技能习得。我们通过随机对照实验,研究开发者在有 AI 辅助与无 AI 辅助的情况下,如何掌握一个新的异步编程库。研究发现,使用 AI 会削弱参与者的概念理解、代码阅读能力以及调试能力,而平均来看并未带来显著的效率提升。那些完全将编码任务委托给 AI的参与者确实获得了一定的生产力提升,但代价是未能真正学习该编程库。我们识别出 六种不同的 AI 交互模式,其中 三种涉及认知参与,即使参与者获得 AI 辅助,也能够保持良好的学习效果。研究结果表明,AI 带来的生产力提升并不是通往能力提升的捷径。在将 AI 辅助纳入工作流程时应谨慎设计,以保护技能的形成——尤其是在安全关键领域。原文链接:https://arxiv.org/abs/2601.20245

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Shaping capabilities with token-level data filteringSummary当前减少语言模型不良能力的方法大多是事后处理(post hoc)的,因此很容易被对抗者绕过。一种更自然的替代方案是在预训练阶段就对能力进行塑造。以移除医疗相关能力这一代理任务为例,我们表明,仅通过过滤预训练数据这一简单干预,就能够在大规模情况下实现高度有效、稳健且成本低廉的效果。受到数据归因(data attribution)相关研究的启发,我们进一步表明,与过滤文档相比,过滤 token 更为有效:在对不希望出现的能力造成同等抑制效果的同时,对正常能力的影响更小。通过训练跨越两个数量级规模的模型,我们还展示了:随着模型规模增大,过滤策略的效果也会增强。在我们最大的模型上,token 级过滤会使模型在“需要遗忘的领域(forget domain)”上的计算效率降低 7000 倍。我们还表明,通过 token 过滤训练得到的模型,依然可以在该遗忘领域上进行对齐。在这一过程中,我们提出了一种方法:利用稀疏自编码器(sparse autoencoders)对 token 进行标注,并蒸馏出低成本且高质量的分类器。我们还证明,只要预训练计算量足够,过滤方法在存在噪声标签的情况下依然具有鲁棒性。原文链接:https://arxiv.org/abs/2601.21571

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Kimi K2.5: Visual Agentic IntelligenceSummary我们介绍 Kimi K2.5,一个开源的多模态智能体模型,旨在推动通用智能体能力的发展。K2.5 强调对文本与视觉的联合优化,使两种模态能够相互增强。这一过程包含一系列技术,例如文本—视觉联合预训练、零视觉监督微调(zero-vision SFT),以及文本—视觉联合强化学习。在这一多模态基础之上,K2.5 引入了 Agent Swarm,一种自驱动的并行智能体编排框架,能够将复杂任务动态分解为异构子问题,并并发执行。大量评估表明,Kimi K2.5 在多个领域(包括编程、视觉、推理以及智能体任务)上达到了当前最先进的水平。与单智能体基线相比,Agent Swarm 还可将延迟降低最多 4.5 倍。我们发布了经过后训练的 Kimi K2.5 模型检查点,以促进未来在智能体智能领域的研究和实际应用。原文链接:https://arxiv.org/abs/2602.02276

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Anamorphic Monero Transactions: the Threat of Bypassing Anti-Money Laundering LawsSummary在本文中,我们分析了以隐私为导向的加密货币与新兴打击金融犯罪法律框架之间的冲突,尤其聚焦于欧盟近期出台的相关法规。我们分析了 Monero(门罗币)这一领先的“隐私币”,它也是执法机构重点关注的对象,并研究在新法律下针对 Monero 交易平台必须履行的尽职调查范围,以及这些要求如何映射到 Monero 协议的技术能力之上。我们既指出了该立法中的缺陷,也识别出一些技术层面的陷阱,这些陷阱可能威胁到例如 Monero 交易所的有效合规,或是 Monero 自身的匿名化目标。另一个具有独立研究价值的方面是,我们引入了变形密码学(anamorphic cryptography)(这也是该概念最早的实际应用之一),并利用它在 Monero 区块链中构建了一个隐藏的交易层,用以混淆非法资金流动,并规避欧盟法律在交易层面实施监管的尝试。原文链接:https://eprint.iacr.org/2025/1961

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:A Systematic Literature Review of Information Privacy in Blockchain SystemsSummary在这篇文献综述中,我们对区块链系统中的隐私问题不断发展的研究格局进行了批判性分析,重点关注隐私攻击与防护措施在三个不同层级中的差异: 链上层(on-chain layer) 链下层(off-chain layer) 基础设施层(infrastructure layer),即 点对点网络层(peer-to-peer network layer)在综述中,我们对常见的隐私攻击进行了分类,例如: 交易追踪(transaction tracing) 数据泄露(data leakage) 网络监控(network surveillance)并分析这些攻击在不同层级上的具体表现及其影响。此外,我们还评估了一系列隐私保护技术,包括: 密码学方法(cryptographic methods) 零知识证明(zero-knowledge proofs) 其他隐私保护协议(privacy-preserving protocols)同时,我们探讨了这些隐私技术与现有区块链系统之间的兼容性。通过综合当前的研究成果和实际应用案例,本综述旨在: 提供对区块链环境中隐私挑战与解决方案的全面理解 识别当前研究中的空白与不足 为未来**区块链隐私增强技术(privacy-enhancing technologies)**的发展提供指导。原文链接:https://www.mdpi.com/2624-800X/5/3/65

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:AI IDEs or Autonomous Agents? Measuring the Impact of Coding Agents on Software DevelopmentSummary基于大型语言模型(LLM)的编程智能体(coding agents)正越来越多地作为自主贡献者参与软件开发,例如自动生成并合并 Pull Request。然而,与目前广泛使用的IDE 内置 AI 助手相比,这些智能体在真实软件项目中的影响仍不清楚。我们开展了一项纵向因果研究(longitudinal causal study),分析智能体在开源仓库中的采用效果。研究方法采用分阶段差分中的差分(staggered difference-in-differences)设计,并配合匹配对照组。基于 AIDev 数据集,我们将“采用智能体”定义为仓库首次出现由智能体生成的 Pull Request,并分析仓库按月统计的项目级指标,包括:开发速度(development velocity) 提交次数(commits) 新增代码行数(lines added)软件质量(software quality) 静态分析警告(static-analysis warnings) 认知复杂度(cognitive complexity) 代码重复度(duplication) 注释密度(comment density)研究结果表明: 开发速度提升具有明显的“前期集中效应”:当智能体是项目中首次出现的 AI 工具时,开发速度会出现显著提升。 如果仓库此前已经使用过 AI IDE 助手,那么引入智能体带来的吞吐量提升很小或持续时间很短。相比之下,代码质量风险则更加持久。在不同情境下都观察到: 静态分析警告增加约 18% 认知复杂度增加约 39%这表明即使开发速度优势逐渐消失,由智能体引入的技术债(technical debt)仍会持续累积。这些异质性效应表明 AI 辅助开发存在边际收益递减的现象,同时也凸显出以下需求: 质量保障机制(quality safeguards) 代码来源追踪(provenance tracking) 对自主智能体进行选择性部署本研究为理解智能体式工具(agentic tools)与 IDE AI 助手之间的相互作用提供了实证基础,并推动未来研究探索:在 AI 融合的软件开发流程中,如何在开发效率与可维护性之间取得平衡。本研究的**可复现代码与数据包(replication package)**已通过论文中的链接公开发布。原文链接:https://arxiv.org/abs/2601.13597

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:A self-correcting multi-agent LLM framework for language-based physics simulation and explanationSummary基于物理的模拟在科学和工程领域至关重要,但构建这类模拟通常需要对数值求解器和控制方程(governing equations)具备专业知识。大型语言模型(LLM)为通过自然语言创建模拟提供了新的可能性,但当提示模糊、不完整或包含多语言时,它们往往会失败。为了解决这一问题,我们提出 MCP-SIM(Memory-Coordinated Physics-Aware Simulation),这是一个具备自我纠错能力的多智能体框架,能够将信息不充分的提示转化为经过验证的模拟结果和解释性报告。该系统通过结构化的智能体协作以及持久记忆机制,整合了多个功能模块,包括: 输入澄清(input clarification) 代码生成(code generation) 错误诊断(error diagnosis) 多语言解释(multilingual explanation)与一次性代码生成(one-shot code generation)不同,MCP-SIM 通过迭代式的“计划–执行–反思–修订”(plan–act–reflect–revise)循环来模拟专家式推理过程。在 12 个复杂度逐步提升的任务上进行评估时,该框架成功解决了所有基准测试案例。在本研究定义的特定评估指标下,它在收敛效率方面优于基于 GPT 的方法以及人类参与(human-in-the-loop)的基线方法。除了数值精度之外,该系统还能够生成可解释的报告,并支持多语言输出,用于说明每个模拟背后的物理逻辑。MCP-SIM 向通用型自主科学助手迈出了一步:这种系统能够通过自然语言进行模拟、适应并解释科学问题。尽管在本研究的测试任务中表现出较强的鲁棒性,但在更专业领域以及超出当前基准分布的任务上的表现仍有待未来进一步验证。原文链接:https://www.nature.com/articles/s44387-025-00057-z

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Terminal-Bench: Benchmarking Agents on Hard, Realistic Tasks in Command Line InterfacesSummaryAI 智能体很可能很快就能在多个领域中自主完成具有价值的长期任务(long-horizon tasks)。然而,现有基准测试要么无法反映真实世界任务,要么难度不足以有效评估前沿模型。为此,我们提出 Terminal-Bench 2.0:一个精心构建的高难度基准测试。该基准包含 89 个任务,全部在计算机终端环境(terminal environments)中完成,并且这些任务都来源于真实工作流程中的问题。每个任务都包含: 独立的运行环境 人工编写的参考解决方案 完整的自动化测试(用于验证结果)实验结果表明,当前的前沿模型和智能体在该基准上的得分低于 65%。我们还进行了错误分析(error analysis),以识别模型和智能体在未来需要改进的关键能力方向。为了支持开发者和研究人员的进一步研究,我们公开发布了数据集和评测框架(evaluation harness),可通过论文中的链接获取。原文链接:https://arxiv.org/abs/2601.11868

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Rethinking the Value of Multi-Agent Workflow: A Strong Single Agent BaselineSummary最近基于大型语言模型(LLM)的多智能体系统(Multi-Agent Systems, MAS)取得了显著进展。研究表明,由多个 LLM 智能体组成的工作流——每个智能体具有不同的角色、工具和通信模式——在复杂任务上可以优于单一 LLM 的基线方法。然而,大多数现有框架实际上是同质(homogeneous)的:所有智能体使用同一个基础 LLM,只是在提示词、工具使用方式以及在工作流中的位置上有所不同。这就引出了一个问题:这样的工作流是否可以通过一个单一智能体在多轮对话中进行模拟?我们在 七个基准测试上对此进行了研究,这些基准涵盖: 编程(coding) 数学(mathematics) 通用问答(general QA) 领域特定推理(domain-specific reasoning) 真实世界规划与工具使用(real-world planning and tool use)实验结果表明:一个单一智能体可以达到同质多智能体工作流的性能,同时由于能够复用 KV cache(键值缓存),在推理效率上具有优势。进一步地,它甚至能够匹配**自动优化的异构工作流(heterogeneous workflow)**的性能。基于这一发现,我们提出了 OneFlow 算法。该算法可以自动将多智能体工作流转换为适用于单一智能体执行的形式。与现有的自动化多智能体设计框架相比,OneFlow 在不降低准确率的情况下显著降低推理成本。这些结果表明:用单一 LLM 实现多智能体工作流可以作为多智能体系统研究中的一个强有力基线(baseline)。同时我们也指出,单一 LLM 方法仍然存在局限:由于不同 LLM 之间无法共享 KV cache,单模型方案无法真正模拟异构(heterogeneous)工作流。这也表明未来仍然存在重要研究机会,即开发真正异构的多智能体系统。原文链接:https://arxiv.org/abs/2601.12307

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:AI Agents Need Memory Control Over More ContextSummaryAI 智能体正越来越多地被用于长期、多轮的工作流程中,无论是在科研还是企业环境中。随着交互轮数的增加,智能体的行为往往会逐渐退化,原因包括:约束目标逐渐失焦、错误不断累积,以及由记忆引发的行为漂移(drift)。这一问题在真实世界部署中尤为明显,因为上下文会持续变化、会出现各种干扰,而且决策需要在较长时间内保持一致。一种常见做法是为智能体提供持久记忆,例如通过对话记录回放(transcript replay)或基于检索的机制(retrieval-based memory)。虽然这种方式实现起来比较方便,但它会导致上下文无限增长,并且容易受到**噪声检索和记忆污染(memory poisoning)**的影响,从而造成行为不稳定以及更严重的漂移问题。在这项工作中,我们提出了 Agent Cognitive Compressor(ACC),一种受生物系统启发的记忆控制器。ACC 不再依赖完整对话记录回放,而是使用一个有界的内部状态(bounded internal state),并在每一轮交互时在线更新。ACC 的关键设计是将“信息检索(artifact recall)”与“状态承诺(state commitment)”分离: 允许智能体检索外部信息进行参考; 但不会在未经验证的情况下将这些信息写入持久记忆。这种机制既能提供稳定的条件信息,又能防止不可靠内容进入长期记忆。我们使用一种由智能体评审(agent judge)驱动的实时评估框架来评估 ACC,该框架不仅衡量任务完成效果,还监测由记忆引发的异常行为,并在长时间交互中进行评估。在多个应用场景中进行实验,包括: IT 运维(IT operations) 网络安全响应(cybersecurity response) 医疗工作流程(healthcare workflows)结果表明,ACC 能够始终保持有界的记忆规模,并在多轮交互中表现出更稳定的行为;与使用对话回放或检索记忆的智能体相比,它显著降低了幻觉(hallucination)和行为漂移(drift)。这些结果表明,认知压缩(cognitive compression)为长期运行的 AI 智能体提供了一种实用且有效的记忆控制基础。原文链接:https://arxiv.org/abs/2601.11653

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Reasoning Models Generate Societies of ThoughtSummary大型语言模型已经在多个领域展现出卓越能力,但复杂推理能力背后的机制仍然难以完全解释。近期的一些推理模型在复杂认知任务上明显优于规模相当的指令微调模型,这通常被归因于通过更长的思维链(chain of thought)进行更多计算。然而,我们的研究表明,推理能力的提升并不仅仅来自更长的计算过程,而是源于一种类似多智能体交互的模拟机制——“思想社会”(society of thought)。这种机制使模型能够在内部产生多种认知视角,并在这些视角之间进行多样化和辩论。这些视角通常表现为具有不同人格特征和领域专长的内部角色。通过对推理轨迹进行定量分析以及使用机制可解释性(mechanistic interpretability)方法,我们发现像 DeepSeek-R1 和 QwQ-32B 这样的推理模型相比普通指令微调模型,表现出更高的视角多样性。在推理过程中,它们会激活更广泛的冲突信号,这些信号来自具有不同人格特征和专业知识相关特征的内部表示。这种多智能体结构具体表现为多种对话式行为,例如: 提问与回答(question–answering) 视角转换(perspective shifts) 对冲突观点的协调与整合(reconciliation of conflicting views)同时还表现出带有社会情绪角色的互动,例如尖锐的来回讨论。这些行为共同构成了一种类似对话的推理过程,从而带来了在推理任务上的准确率优势。进一步的受控强化学习实验表明:当基础模型仅仅因为推理准确率而获得奖励时,它们会自然增加这种对话式行为。此外,在微调过程中加入对话式结构(conversational scaffolding),能够使模型的推理能力提升速度快于未加入该结构的基础模型。这些结果表明,思想的社会化组织有助于更有效地探索解空间。我们认为,推理模型在计算层面上形成了一种与人类群体中的集体智能(collective intelligence)相对应的机制:当多样性被系统性地组织起来时,它能够带来更强的问题解决能力。这也为未来通过多智能体组织结构来利用“群体智慧(wisdom of crowds)”提供了新的研究机会。原文链接:https://arxiv.org/abs/2601.10825

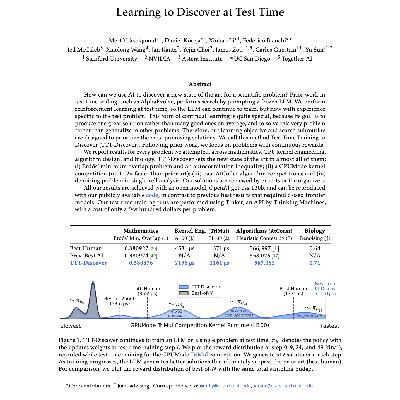

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:Learning to Discover at Test TimeSummary我们如何利用 AI 为某个科学问题发现新的最先进(state-of-the-art)解法?此前关于测试时扩展(test-time scaling)的工作,例如 AlphaEvolve,是通过提示一个冻结(不再训练)的 LLM 来进行搜索。我们的做法是在测试阶段进行强化学习,使 LLM 在解决问题时仍然可以继续训练,但训练经验专门来自当前这个测试问题。这种持续学习(continual learning)的形式非常特殊,因为它的目标并不是在平均意义上产生许多不错的解,而是找到一个非常优秀的解;并且是专门解决当前这个问题,而不是泛化到其他问题。因此,我们的学习目标和搜索子程序被设计为优先关注最有希望的解。我们将这种方法称为 Test-Time Training to Discover(TTT-Discover)。沿用以往研究,我们重点关注**具有连续奖励(continuous rewards)**的问题。我们报告了所有尝试过的问题结果,涵盖以下领域:数学、GPU 内核工程、算法设计以及生物学。TTT-Discover 在几乎所有这些任务上都创造了新的最先进结果,包括: Erdős 的最小重叠问题以及一个自相关不等式; 一个 GPUMode 内核竞赛(速度最高可达此前最佳结果的 2 倍); 过去的 AtCoder 算法竞赛问题; 单细胞分析中的去噪问题。我们的解决方案均由相关领域专家或比赛组织者进行了评审。所有结果都使用一个开源模型 OpenAI gpt-oss-120b 实现,并且可以通过我们公开发布的代码进行复现;相比之下,以往的最佳结果通常依赖于封闭的前沿模型。我们的测试时训练实验通过 Thinking Machines 提供的 Tinker API 运行,每个问题的成本仅为几百美元。原文链接:https://arxiv.org/abs/2601.16175

Seventy3:借助NotebookLM的能力进行论文解读,专注人工智能、大模型、机器人算法、crypto方向,让大家跟着AI一起进步。如果你有自己的论文要解读,或者推荐论文,请留言。今天的主题是:A Formal Analysis of the Mimblewimble Cryptocurrency Protocol with a Security ApproachSummaryMimbleWimble(MW) 是一种以隐私为核心设计目标的加密货币技术,在安全性与可扩展性方面展现出区别于同类协议的特性。本文对这些关键属性进行了系统性阐述,并提出了一种基于模型驱动验证(model-driven verification)的形式化方法,用于验证协议实现的正确性与安全性。具体而言,作者构建了一个理想化模型(idealized model),作为整个验证流程的核心基础。在此框架下,论文明确识别并精确定义了一组充分条件,以确保该模型能够支持对 MW 关键安全属性(如一致性、完整性与隐私性)的形式化验证。鉴于 MW 构建于共识协议之上,研究进一步对某一类共识协议给出了 Z 语言规范(Z specification) 描述,并展示了由该 Z 规范自动生成的 {log} 原型系统的部分内容。该 {log} 原型可作为可执行模型(executable model)运行仿真,从而在无需底层编程实现的情况下分析协议行为。这种方法显著降低了验证成本,同时提高了形式化分析的严谨性。最后,论文对当前基于 MW 协议实现的两个主要项目进行了分析: Grin Beam研究评估了它们在当前开发阶段的实现特性与协议一致性状况,从形式化验证视角探讨其安全保障程度。总体而言,该工作不仅阐明了 MW 在隐私与可扩展性方面的理论基础,还提出了一套可执行的形式化验证路径,为隐私型区块链协议的认证与安全评估提供了系统化方法论。原文链接:https://arxiv.org/abs/2104.00822